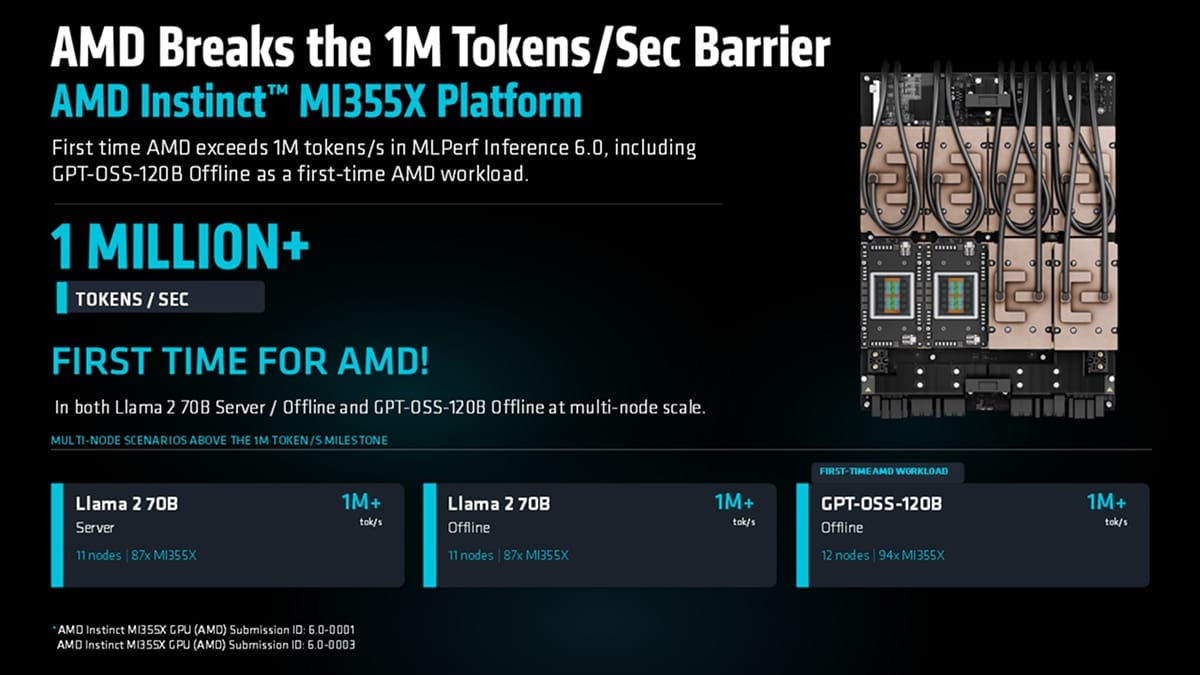

AMD obtuvo en las pruebas MLPerf Inference v6.0 resultados con las GPU Instinct MI355X que superan el millón de tokens por segundo en inferencia generativa sobre configuraciones multinodo.

AMD usa MLPerf Inference 6.0 para mostrar salto de throughput y escalado multinodo con MI355X

MLPerf Inference 6.0 es una suite de pruebas de MLCommons para medir desempeño de inferencia en centros de datos. En este caso, AMD la usa para mostrar cómo responden sus GPU Instinct MI355X en throughput y escalado con modelos de lenguaje ya desplegados.

Rendimiento base con AMD Instinct MI355X

Resultados de rendimiento directo con MI355X. Aquí AMD busca fijar el punto de partida de su plataforma en pruebas concretas de Llama 2 70B y GPT-OSS-120B, tanto en servidor como en configuraciones de mayor volumen.

- Llama 2 70B Server: 100.282 tokens por segundo.

- Llama 2 70B multinodo Offline: 1.042.110 tokens por segundo.

- Llama 2 70B multinodo Server: 1.016.380 tokens por segundo.

- Llama 2 70B multinodo Interactive: 785.522 tokens por segundo.

- GPT-OSS-120B multinodo Offline: 1.031.070 tokens por segundo.

- GPT-OSS-120B multinodo Server: 900.054 tokens por segundo.

Salto frente a la generación anterior

La compañía usa Llama 2 70B Server como referencia para sostener que MI355X abre una diferencia clara respecto de MI325X en throughput.

- MI355X en Llama 2 70B Server: 100.282 tokens por segundo.

- MI325X en la referencia previa: 32.028 tokens por segundo.

- Mejora declarada por AMD: 3,1 veces más throughput.

Escala multinodo y eficiencia

Este bloque agrupa la escala multinodo y la eficiencia obtenida al crecer en clúster. AMD intenta demostrar que el rendimiento no queda acotado a una sola máquina y se mantiene al expandir la infraestructura.

- Llama 2 70B: 11 nodos y 87 GPU MI355X.

- Eficiencia en Llama 2 70B: 93% en Offline, 93% en Server y 98% en Interactive.

- GPT-OSS-120B: 12 nodos y 94 GPU MI355X.

- Eficiencia en GPT-OSS-120B: 92% en Offline y 93% en Server.