La industria tecnológica está experimentando una transición operativa fundamental donde los sistemas de inteligencia artificial dejan de ser herramientas exclusivas para la generación de respuestas de texto y se convierten en agentes autónomos capaces de gestionar flujos de trabajo corporativos de principio a fin.

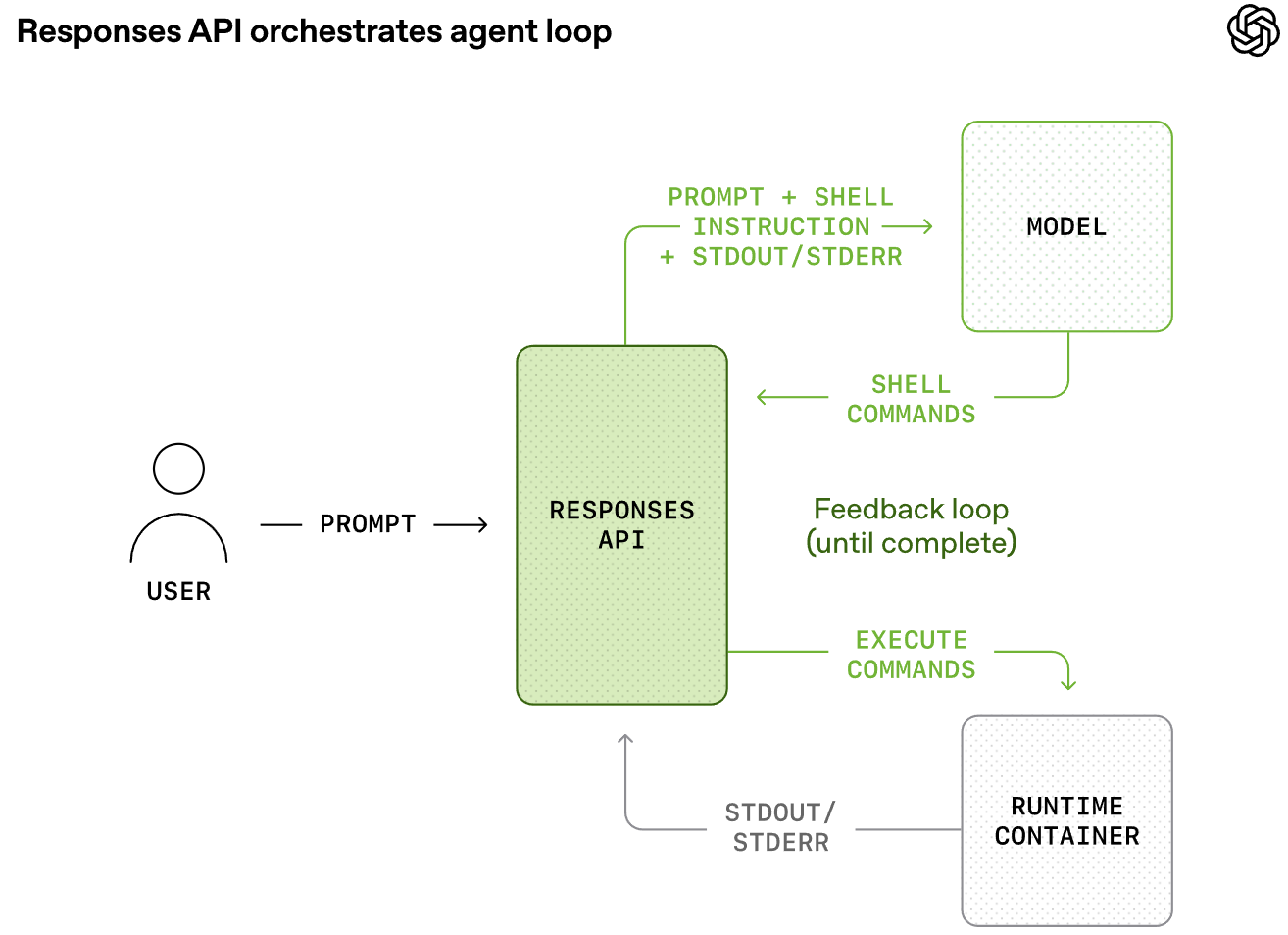

Para materializar esta capacidad de gestión en aplicaciones empresariales reales, OpenAI ha dotado a su interfaz de programación de un entorno computacional estructurado que permite a los modelos interactuar directamente con documentos, bases de datos y redes externas sin requerir intervención o supervisión humana constante.

Despliegue de contenedores aislados para la ejecución segura de comandos

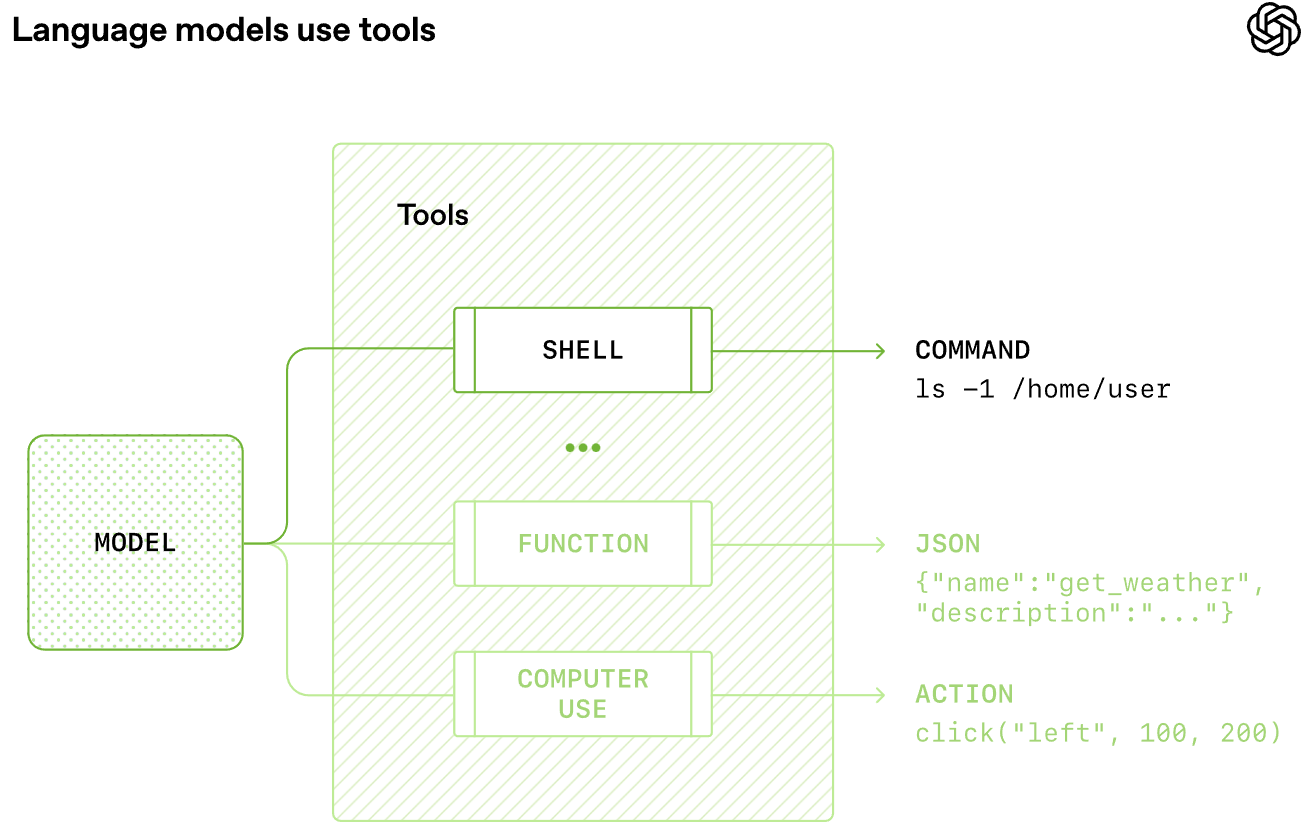

El soporte técnico principal de esta integración es la incorporación de una herramienta de consola nativa que habilita a la inteligencia artificial para procesar y ejecutar comandos de sistema dentro de un contenedor de trabajo completamente aislado.

Esta arquitectura transforma la dinámica de uso al permitir que el agente asuma un rol activo donde escribe sus propios programas informáticos, los somete a prueba para evaluar los resultados, identifica posibles fallos lógicos y aplica las correcciones correspondientes de manera inmediata e independiente.

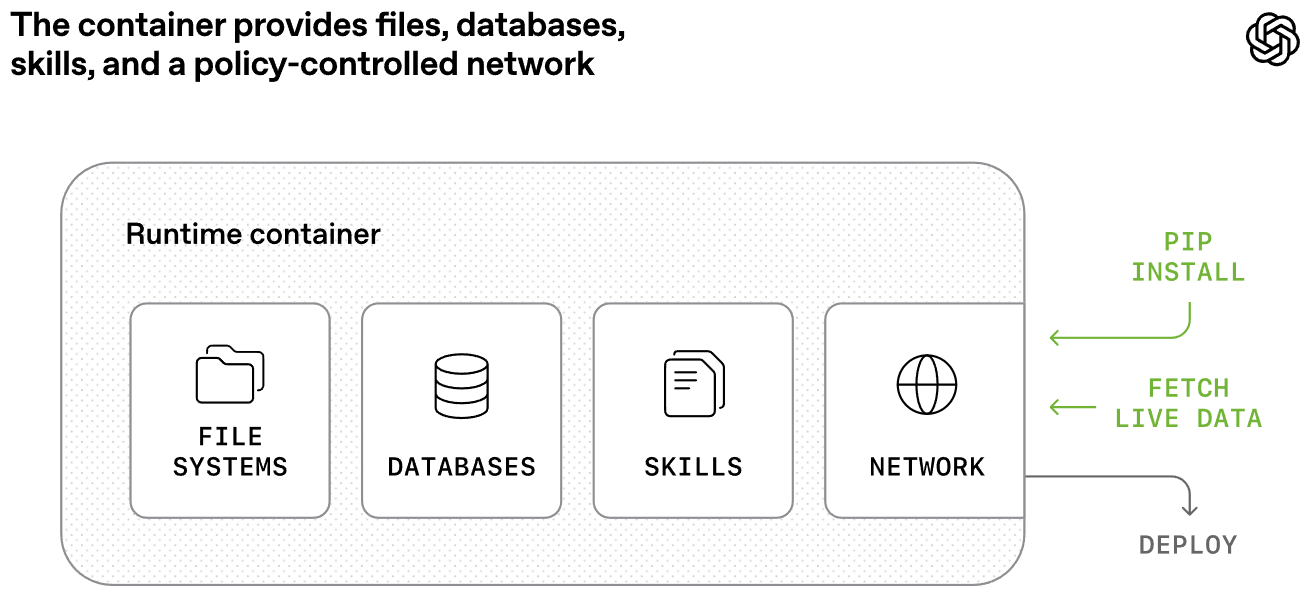

La disponibilidad de este entorno de ejecución otorga a las corporaciones la capacidad de procesar volúmenes de información compleja en paralelo, utilizando lenguajes de programación de estándar empresarial para consultar directamente sus bases de datos estructuradas.

Optimización de memoria a largo plazo y empaquetado de flujos de trabajo

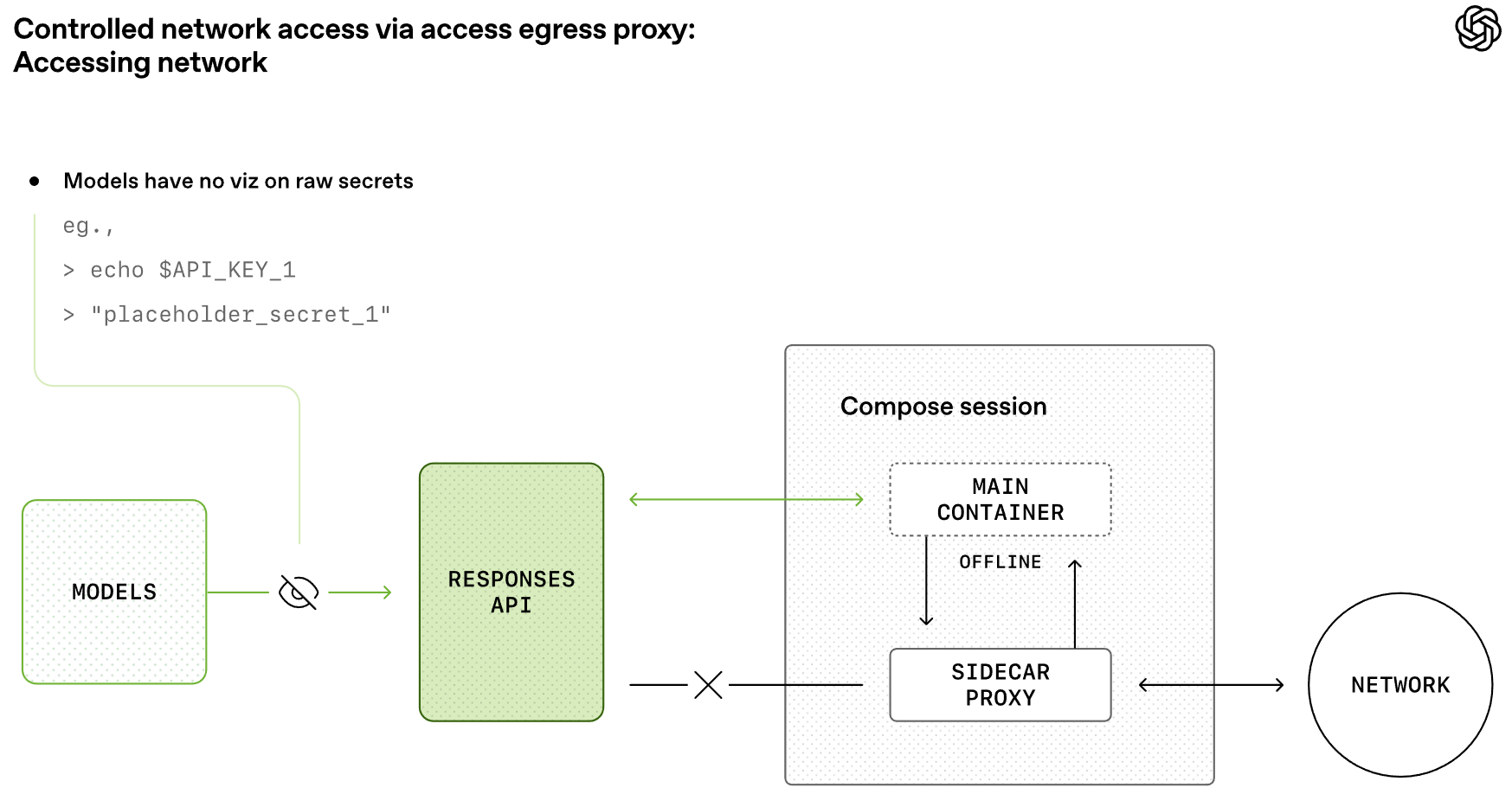

Para mitigar los riesgos informáticos inherentes a la automatización de accesos a internet, la infraestructura implementa un proxy de salida estricto que centraliza y filtra todo el tráfico de red, garantizando que el agente pueda extraer datos de servicios de terceros sin exponer bajo ninguna circunstancia las credenciales corporativas de la organización.

La ejecución ininterrumpida de tareas de alta complejidad técnica suele saturar la capacidad de retención de los modelos tradicionales, por lo que este nuevo sistema integra una función de compactación nativa que resume continuamente el estado del proceso en curso para preservar únicamente el contexto operativo esencial y mantener la coherencia analítica a lo largo del tiempo.

Como complemento definitivo a la optimización de los recursos de memoria, la plataforma ahora permite configurar y almacenar rutinas técnicas predefinidas bajo el concepto de habilidades empaquetadas, evitando que la infraestructura computacional deba analizar y deducir desde cero los pasos metodológicos de un flujo de trabajo repetitivo en cada nueva solicitud.