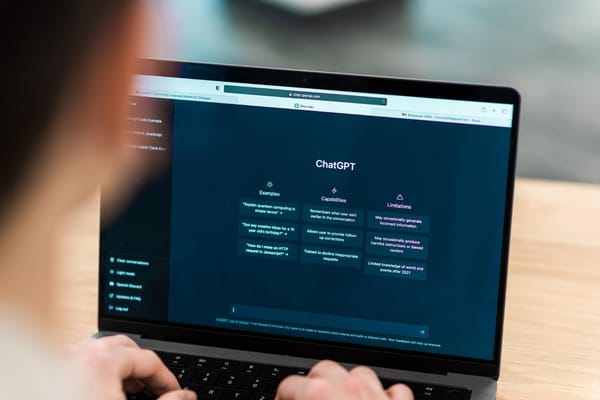

El uso de plataformas públicas de inteligencia artificial está generando un nuevo riesgo de fuga de datos para las empresas en América Latina. Según Kaspersky, empleados que buscan optimizar su productividad comparten en sistemas de IA generativa bases de datos, reportes sensibles o documentos oficiales, lo que abre la puerta a filtraciones de información confidencial y eleva la exposición frente al cibercrimen.

Claudio Martinelli, director general para las Américas en Kaspersky, advirtió sobre el impacto de este fenómeno y señaló:

“Actualmente, el temor de las empresas también está relacionado con el uso que algunos empleados hacen de plataformas de IA Generativa, compartiendo en ellas datos confidenciales, es decir, usan inteligencia artificial sin inteligencia humana. No se trata de delegar todo a una herramienta, sino de entender los riesgos, cuidar la confidencialidad y entrenar a los empleados para que sepan cómo usar la IA”.

La compañía explicó que, además de los 467.000 objetos maliciosos detectados diariamente, los equipos de seguridad deben lidiar con la indexación de conversaciones de IA en buscadores web, lo que ya ha expuesto chats de usuarios en temas sensibles como vida privada o salud mental. Esta práctica podría también comprometer consultas internas con datos empresariales críticos.

Ante este panorama, Kaspersky recomienda a las empresas fortalecer la capacitación en ciberseguridad de los empleados, efectuar evaluaciones de riesgos y modelado de amenazas, garantizar seguridad en la infraestructura y la nube, reforzar la cadena de suministro, validar periódicamente los sistemas de IA y establecer reportes de vulnerabilidades.

Además, sugiere implementar defensas específicas contra ataques a modelos de aprendizaje automático, mantener software e infraestructura actualizados y cumplir con estándares internacionales para asegurar la protección de datos y la confianza de clientes y socios.