Microsoft ha publicado el nuevo informe Cyber Pulse para ofrecer a los líderes conocimientos prácticos y orientación sobre nuevos riesgos de ciberseguridad. Una de las preocupaciones más urgentes hoy es la gobernanza de la IA y los agentes autónomos.

Los agentes de IA escalan más rápido de lo que algunas empresas pueden percibirlos, y esa brecha de visibilidad supone un riesgo empresarial.Al igual que las personas, los agentes de IA requieren protección mediante una fuerte observabilidad, gobernanza y seguridad a través de los principios de Zero Trust (Confianza Cero).

Como destaca el informe, las organizaciones que tengan éxito en la siguiente fase de adopción de la IA serán aquellas que se muevan con rapidez y reúnan equipos de negocio, TI, seguridad y desarrolladores para observar, gobernar y asegurar su transformación en IA.

La creación de agentes no se limita a roles técnicos; hoy en día, los empleados en diversos puestos crean y utilizan agentes en el trabajo diario. Más del 80% de las empresas Fortune 500 hoy en día utilizan agentes activos de IA construidos con herramientas low-code/no-code (poco código/sin código).

La IA es omnipresente en muchas operaciones, y los agentes impulsados por IA generativa están integrados en flujos de trabajo en ventas, finanzas, seguridad, atención al cliente e innovación de productos.

Con el uso de agentes en expansión y las oportunidades de transformación multiplicándose, ahora es el momento de establecer controles fundamentales. Los agentes de IA deberían estar sujetos a los mismos estándares que los empleados o las cuentas de servicio. Eso significa aplicar de manera coherente los principios de seguridad de Confianza Cero:

- Acceso con el menor privilegio: Dar a cada usuario, agente de IA o sistema solo lo que necesita—nada más.

- Verificación explícita: Confirmar siempre quién o qué solicita acceso a través de identidad, estado del dispositivo, ubicación y nivel de riesgo.

- Suponer que puede producirse un compromiso: Diseñar sistemas y esperar que los ciberatacantes se infiltren.

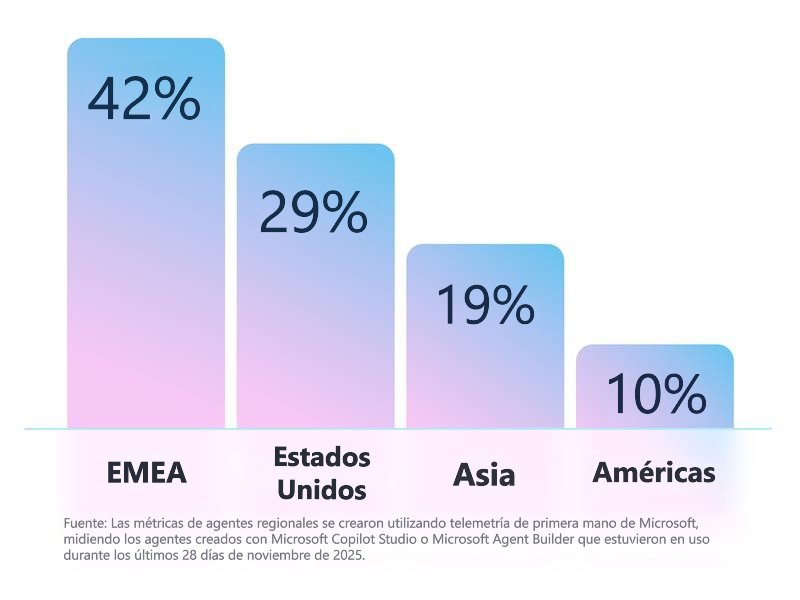

Estos principios no son nuevos, y muchos equipos de seguridad han implementado principios de Zero Trust en su organización. Lo nuevo es su aplicación para usuarios no humanos que operan a gran escala y velocidad. Las organizaciones que integren estos controles en su despliegue de agentes de IA desde el principio podrán avanzar más rápido, lo que genera confianza en la IA.El auge de los agentes de IA liderados por humanosEl crecimiento de los agentes de IA se extiende a muchas regiones del mundo, desde América hasta Europa, Oriente Medio y África (EMEA, por sus siglas en inglés), y Asia.

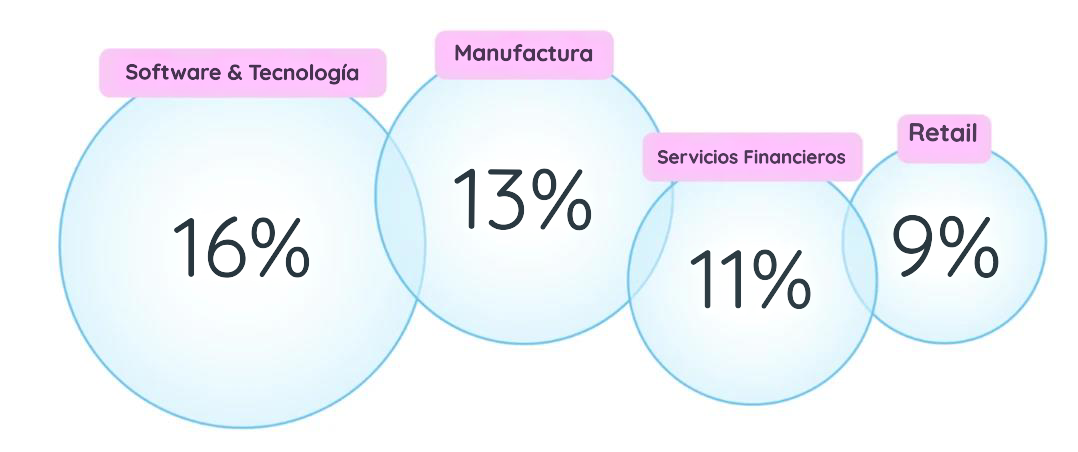

Según Cyber Pulse, industrias líderes como el software y la tecnología (16%), la fabricación (13%), las instituciones financieras (11%) y el comercio minorista (9%) utilizan agentes para apoyar tareas cada vez más complejas: redactar propuestas, analizar datos financieros, triar alertas de seguridad, automatizar procesos repetitivos y sacar información a la velocidad de una máquina.3 Estos agentes pueden operar en modos asistidos, para responder a prompts del usuario o ejecutar tareas de manera autónoma, con mínima intervención humana.

Y a diferencia del software tradicional, los agentes son dinámicos. Actúan. Deciden. Acceden a los datos. Y cada vez más, interactúan con otros agentes. Eso cambia el perfil de riesgo de manera fundamental.El punto ciego: Crecimiento de agentes sin observabilidad, gobernanza ni seguridadA pesar de la rápida adopción de agentes de IA, muchas organizaciones tienen dificultades para responder a algunas preguntas básicas:

- ¿Cuántos agentes recorren la empresa?

- ¿Quién los posee?

- ¿Qué datos tocan?

- ¿Qué agentes están sancionados y cuáles no?

Esto no es una preocupación hipotética. La tecnología de la información en la sombra existe desde hace décadas, pero la IA en la sombra introduce nuevas dimensiones de riesgo. Los agentes pueden heredar permisos, acceder a información sensible y generar resultados a gran escala, a veces fuera de la visibilidad de los equipos de TI y seguridad.

Los actores malintencionados podrían explotar el acceso y privilegios de los agentes, convirtiéndolos en agentes dobles no intencionados. Al igual que los empleados humanos, un agente con demasiado acceso —o con instrucciones erróneas— puede convertirse en una vulnerabilidad. Cuando los líderes carecen de observabilidad en su ecosistema de IA, el riesgo se acumula en silencio.

Según el informe de Cyber Pulse 2026, ya el 29% de los empleados han recurrido a agentes de IA no autorizados para tareas laborales.4 Esta disparidad es notable, ya que indica que numerosas organizaciones despliegan capacidades y agentes de IA antes de establecer los controles adecuados para la gestión de accesos, protección de datos, cumplimiento y responsabilidad.

Finalmente, en sectores regulados como los servicios financieros, la sanidad y el sector público, esta brecha puede tener consecuencias especialmente significativas.