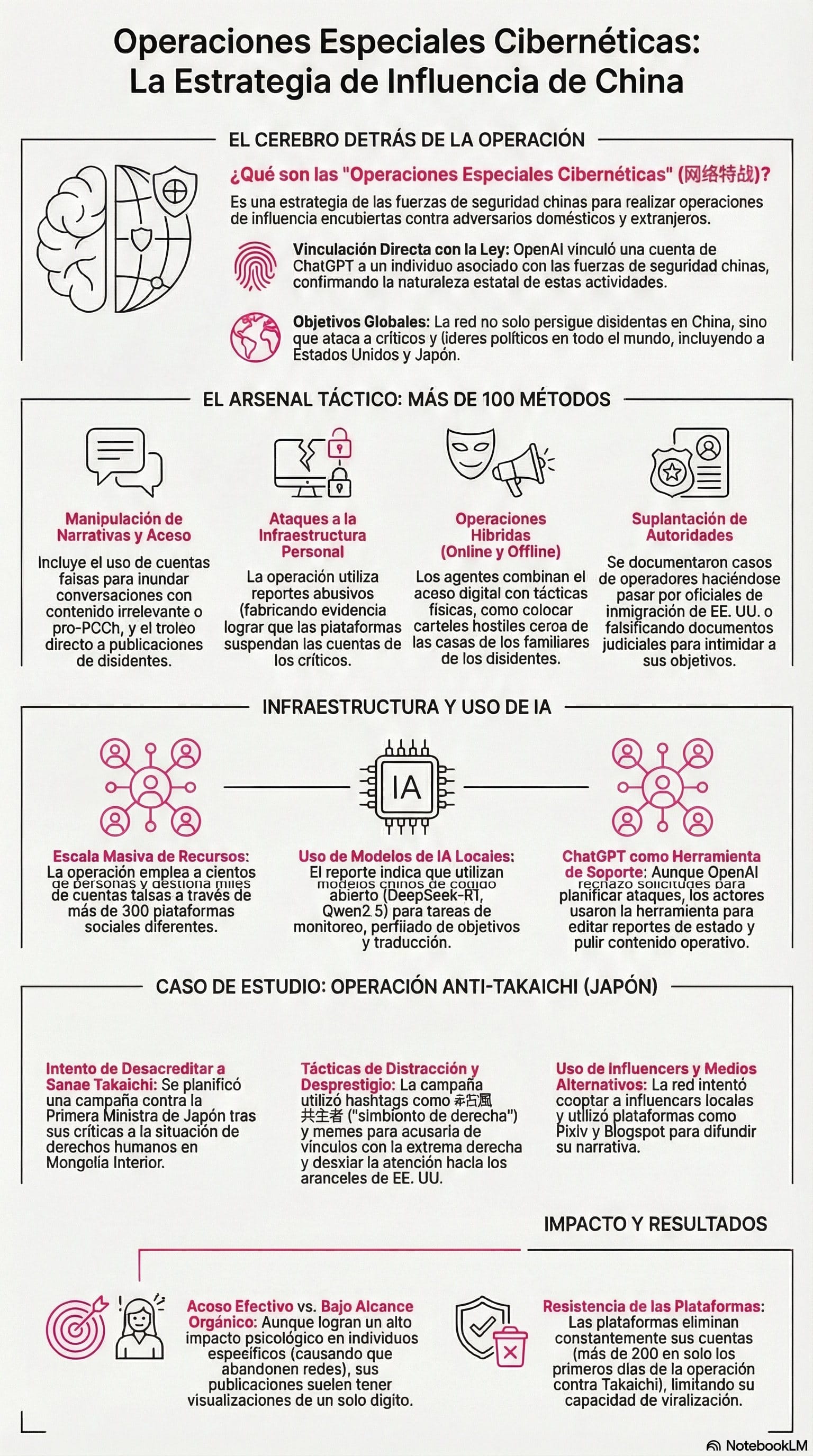

Una investigación técnica titulada “Disrupting malicious uses of our models: an update, February 2026” elaborada por OpenAI revela la estructuración de campañas masivas de influencia encubierta. Este análisis advierte a la alta gerencia sobre tácticas sistemáticas que emplean inteligencia artificial para silenciar objetivos estratégicos y manipular la opinión pública en múltiples plataformas.

Automatización del acoso y manipulación de plataformas

El documento detalla cómo estas infraestructuras operativas utilizan modelos de lenguaje para coordinar miles de cuentas falsas y ejecutar ataques de desprestigio sostenidos. Los atacantes explotan los sistemas de moderación corporativos mediante envíos masivos de denuncias fraudulentas con el propósito de bloquear perfiles legítimos.

Esta metodología delictiva incluye la creación de sitios web paralelos y la falsificación de documentos para engañar a los equipos de soporte técnico de las plataformas. La capacidad de generar pruebas sintéticas permite a los atacantes escalar sus agresiones digitales con un nivel de sofisticación que vulnera los perímetros tradicionales de seguridad.

Desafíos estratégicos para la protección institucional

Las organizaciones modernas deben prepararse ante la integración de herramientas generativas en flujos de trabajo hostiles diseñados para dañar la integridad institucional. El despliegue simultáneo de operaciones en cientos de redes sociales exige una actualización profunda de los protocolos de monitoreo y respuesta a incidentes.