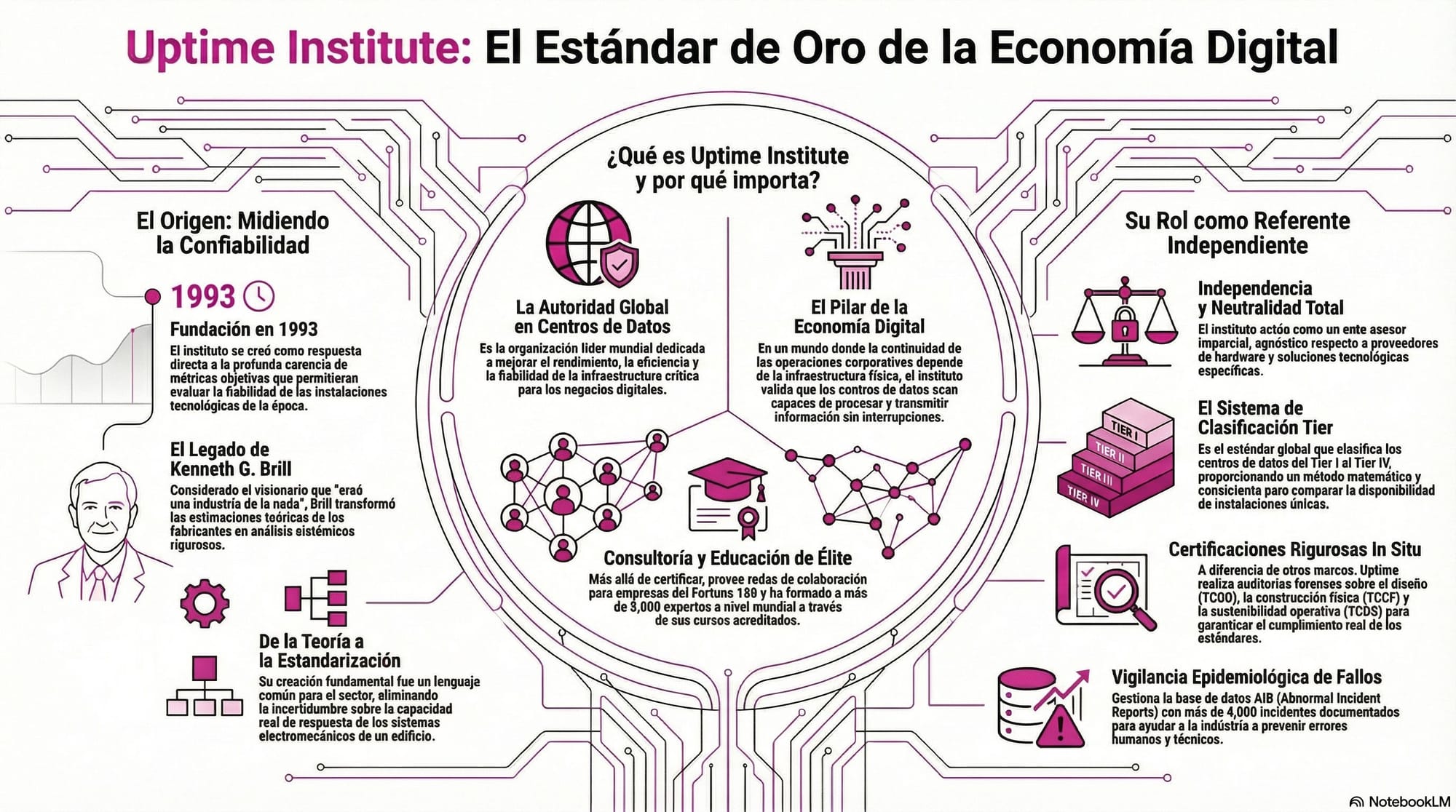

La economía digital depende de infraestructura física capaz de sostener operaciones sin interrupciones, incluso cuando aumentan la demanda, la complejidad técnica y la exposición al riesgo. En ese contexto, Uptime Institute se convirtió en una referencia internacional para evaluar la resiliencia de los data centers y dar un marco común a las decisiones sobre disponibilidad, diseño y operación.

¿Qué es Uptime Institute y por qué importa en la economía digital?

Entender el papel de Uptime Institute exige partir por el problema que vino a resolver. Su relevancia no nace solo de una clasificación conocida en la industria, sino de haber instalado un criterio de evaluación que permitió comparar, ordenar y validar infraestructura crítica con una lógica más consistente para el negocio.

El origen de una entidad creada para medir confiabilidad

Uptime Institute fue fundado en 1993 en un momento en que la industria carecía de métricas objetivas y estandarizadas para evaluar la confiabilidad de los entornos tecnológicos críticos. Esa falta de referencias comunes dificultaba comparar instalaciones y también limitaba la capacidad de las empresas para dimensionar su verdadero nivel de resiliencia.

En la práctica, eso significaba que muchas decisiones se apoyaban en promesas técnicas, criterios parciales o aproximaciones poco homogéneas. La aparición de un marco independiente permitió empezar a medir la infraestructura de soporte con una lógica más clara, vinculada a continuidad operativa y desempeño esperado.

Su rol como referencia independiente para infraestructura crítica

La importancia de Uptime Institute no se limita a haber introducido una clasificación reconocible en el mercado. Su peso real está en haberse posicionado como una entidad orientada a mejorar de forma medible la confiabilidad, la eficiencia operativa y el desempeño de la infraestructura crítica para el negocio.

Para la alta gerencia, ese punto cambia el enfoque de la conversación. La infraestructura deja de verse solo como una base técnica y pasa a entenderse como un activo estratégico que afecta riesgo operativo, continuidad de servicio y capacidad de sostener procesos esenciales sin interrupciones.

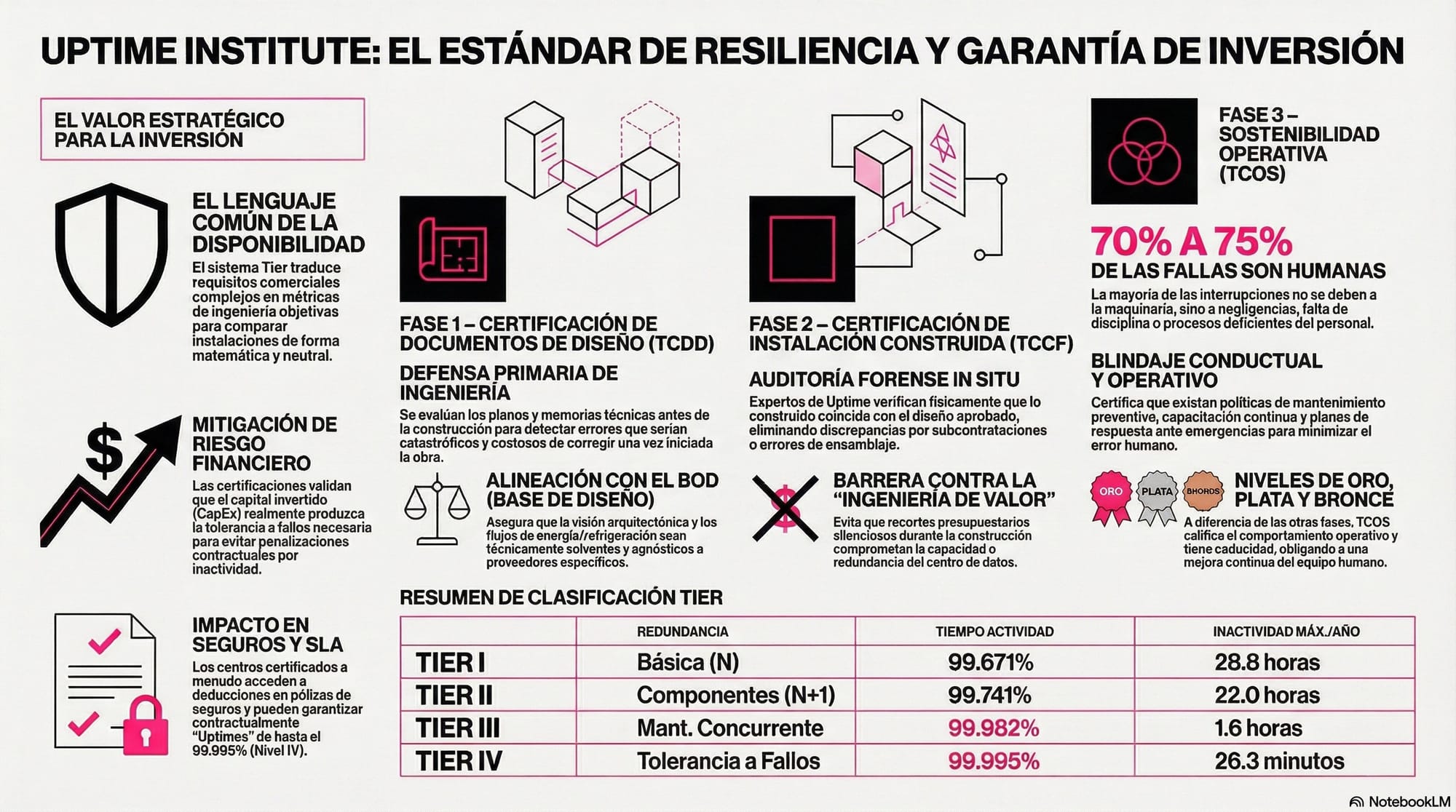

¿Cómo el sistema Tier creó un lenguaje global para medir resiliencia?

La importancia del sistema Tier radica en que convirtió una discusión técnica dispersa en un marco común de evaluación. Antes de su adopción, la confiabilidad de un data center solía describirse con criterios parciales, lo que dificultaba comparar instalaciones, justificar inversiones y alinear expectativas entre áreas técnicas, financieras y de negocio.

¿Qué mide realmente la clasificación Tier?

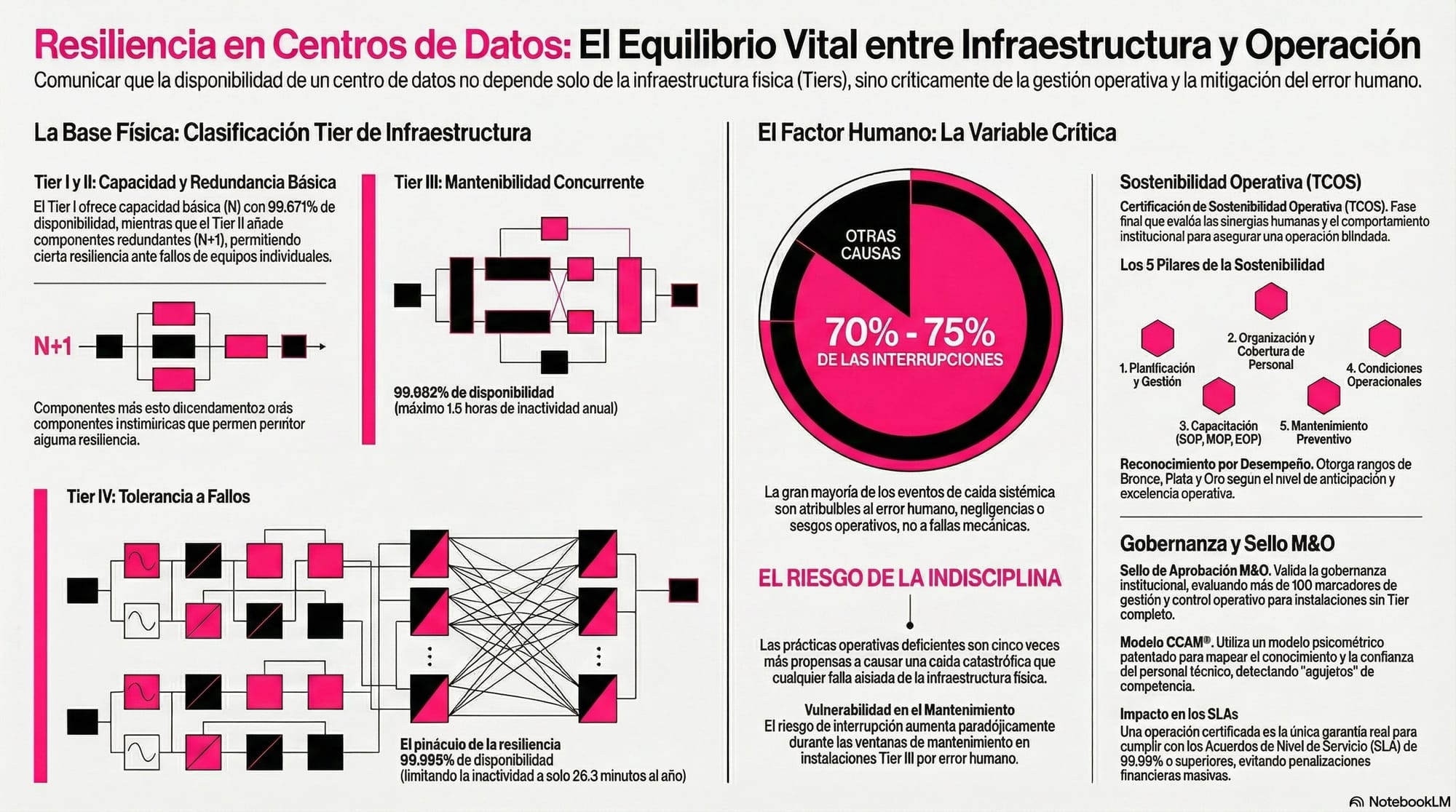

El sistema Tier fue diseñado para evaluar la infraestructura del data center en relación con los requisitos de disponibilidad del negocio. Su aporte central fue desplazar la conversación desde definiciones generales de robustez hacia parámetros vinculados a redundancia, rutas de distribución, mantenibilidad y tolerancia a fallos.

Ese cambio fue decisivo porque permitió medir instalaciones muy distintas con una lógica común, basada en desempeño esperado y continuidad operativa. Para la gerencia, eso significa contar con una referencia útil para entender cuánto riesgo asume la organización según el tipo de infraestructura que sostiene sus procesos críticos.

¿Cómo se diferencian los niveles Tier I, Tier II, Tier III y Tier IV?

La clasificación se organiza en cuatro niveles progresivos, desde Tier I hasta Tier IV, y cada escalón incorpora exigencias adicionales sobre el anterior. No se trata de categorías decorativas, sino de una progresión que refleja distintos grados de resiliencia, complejidad técnica y compromiso de inversión.

Tier I representa una capacidad básica con mayor exposición a interrupciones, mientras Tier II añade componentes redundantes para reducir vulnerabilidades puntuales. Tier III introduce la mantenibilidad concurrente, lo que permite intervenir partes de la infraestructura sin detener la operación, y Tier IV lleva ese principio al nivel más alto con tolerancia a fallos y una arquitectura pensada para resistir eventos más severos sin afectar la carga crítica.

Por qué el modelo se volvió una referencia internacional

Una de las razones de su adopción global es que el sistema no depende de una tecnología específica ni de un proveedor determinado. Su lógica se apoya en el resultado que la infraestructura puede sostener, lo que permite evaluar distintas soluciones bajo un mismo criterio sin favorecer marcas, arquitecturas o enfoques cerrados.

Ese rasgo le dio valor práctico en un mercado internacional donde conviven múltiples diseños, regulaciones y estrategias de expansión. En términos ejecutivos, el sistema Tier terminó funcionando como un lenguaje compartido para ordenar decisiones de riesgo, disponibilidad y CapEx, con una base suficientemente clara como para ser entendida tanto por equipos de ingeniería como por directorios y áreas financieras.

¿Qué certifica realmente Uptime y por qué eso pesa en decisiones de inversión?

La relevancia de Uptime Institute no se explica solo por su sistema de clasificación, sino también por la forma en que articula la validación de un data center a lo largo de su ciclo crítico. Ese enfoque permite revisar el proyecto antes de construir, comprobar la instalación ya ejecutada y evaluar si la operación cotidiana puede sostener en la práctica la disponibilidad comprometida.

Certificación del diseño, la construcción y la operación

Desde la perspectiva de inversión, ese esquema reduce incertidumbre en tres momentos decisivos del proyecto. Primero, al revisar el diseño antes de la obra, ayuda a detectar inconsistencias que podrían traducirse en sobrecostos, reprocesos o una infraestructura incapaz de cumplir el nivel de resiliencia buscado.

Luego, al validar la instalación construida, comprueba que la ejecución física no haya debilitado lo definido en planos ni alterado la lógica de redundancia y continuidad prevista. Esa verificación es clave en proyectos complejos, donde ajustes de obra, recortes o cambios de implementación pueden afectar el desempeño real del sitio.

La tercera capa completa la visión de negocio, porque una instalación robusta no garantiza por sí sola continuidad operativa sostenida. La evaluación sobre la operación incorpora procesos, mantenimiento, organización y disciplina técnica, con lo que la conversación deja de centrarse solo en el edificio y pasa a considerar la capacidad real de sostener el servicio en el tiempo.

¿Por qué la operación importa tanto como la infraestructura?

En la lógica de Uptime Institute, la resiliencia de un data center no se resuelve solo con redundancia eléctrica, rutas de distribución o capacidad de enfriamiento. La operación diaria también forma parte del riesgo, porque una instalación robusta puede degradarse o fallar si los procesos, la disciplina y la preparación del equipo no están a la altura del diseño.

El factor humano como variable crítica de disponibilidad

Este punto es clave porque una parte muy relevante de las interrupciones no se origina en la maquinaria, sino en errores humanos, negligencias, falta de disciplina o procesos deficientes. Eso cambia la conversación, porque obliga a mirar la continuidad no solo desde la infraestructura, sino también desde la forma en que esa infraestructura se administra y se opera.

Por esa razón, la sostenibilidad operativa no se limita a revisar si el edificio fue bien concebido o bien construido. También considera políticas de mantenimiento, entrenamiento continuo, preparación ante emergencias, estructura organizacional y capacidad de respuesta, con el objetivo de reducir vulnerabilidades que no se corrigen solo con más equipamiento.

Para una lectura ejecutiva, la señal es clara. La disponibilidad no depende únicamente del capital invertido en arquitectura crítica, sino de la capacidad de transformar ese diseño en una operación consistente, disciplinada y repetible en el tiempo, porque es ahí donde una organización puede proteger o comprometer de verdad la continuidad del negocio.

¿Cómo influye Uptime en contratos, operación y confianza del mercado?

La influencia de Uptime Institute también se entiende desde su efecto fuera del cuarto técnico. Su marco de evaluación ayuda a traducir decisiones de infraestructura en criterios de continuidad, exposición al riesgo y capacidad de sostener compromisos de servicio frente a clientes, directorios y socios de negocio.

Continuidad operativa, riesgo financiero y confianza de mercado

En términos corporativos, la resiliencia de un data center no es solo un asunto técnico, porque termina impactando la forma en que una empresa respalda sus niveles de servicio. Cuando una instalación se diseña y se opera con un estándar claro de disponibilidad, la organización dispone de una base más sólida para alinear sus compromisos operativos con la capacidad real de su infraestructura.

Ese punto es relevante porque una interrupción no afecta únicamente la operación inmediata. También puede traducirse en incumplimientos, penalidades, deterioro reputacional y pérdida de confianza en entornos donde la continuidad del servicio forma parte central de la propuesta de valor.

Bajo esa lógica, el estándar también cumple una función de ordenamiento para la inversión. No solo ayuda a justificar cuánto resiliencia necesita una organización según su perfil de negocio, sino que también permite evitar tanto la subinversión en entornos críticos como el sobredimensionamiento de infraestructura sin una necesidad claramente respaldada.

¿Cuánto pesa su estándar a escala internacional?

La dimensión global de Uptime Institute es una parte central de su influencia, porque su marco no quedó restringido a un mercado local ni a un grupo acotado de operadores. Su estándar se expandió hasta convertirse en una referencia reconocible para organizaciones que necesitan medir resiliencia, ordenar inversiones y validar continuidad en distintas geografías y sectores.

Alcance global y vigencia en la industria

Ese alcance se refleja tanto en la cantidad de certificaciones y reconocimientos emitidos como en la amplitud de países y tipos de organizaciones que lo han adoptado. Más que una presencia simbólica, se trata de una inserción concreta en una industria donde la disponibilidad de la infraestructura condiciona la operación de servicios financieros, telecomunicaciones, plataformas digitales y procesos empresariales de alta criticidad.

Esa vigencia también explica por qué su sistema mantiene peso en la conversación ejecutiva sobre data centers. A medida que la economía digital exige más continuidad, más densidad tecnológica y menos tolerancia a la interrupción, contar con un estándar entendible y transversal sigue siendo una ventaja para evaluar riesgo, respaldar decisiones y dar una base común a discusiones que involucran ingeniería, operación y negocio.