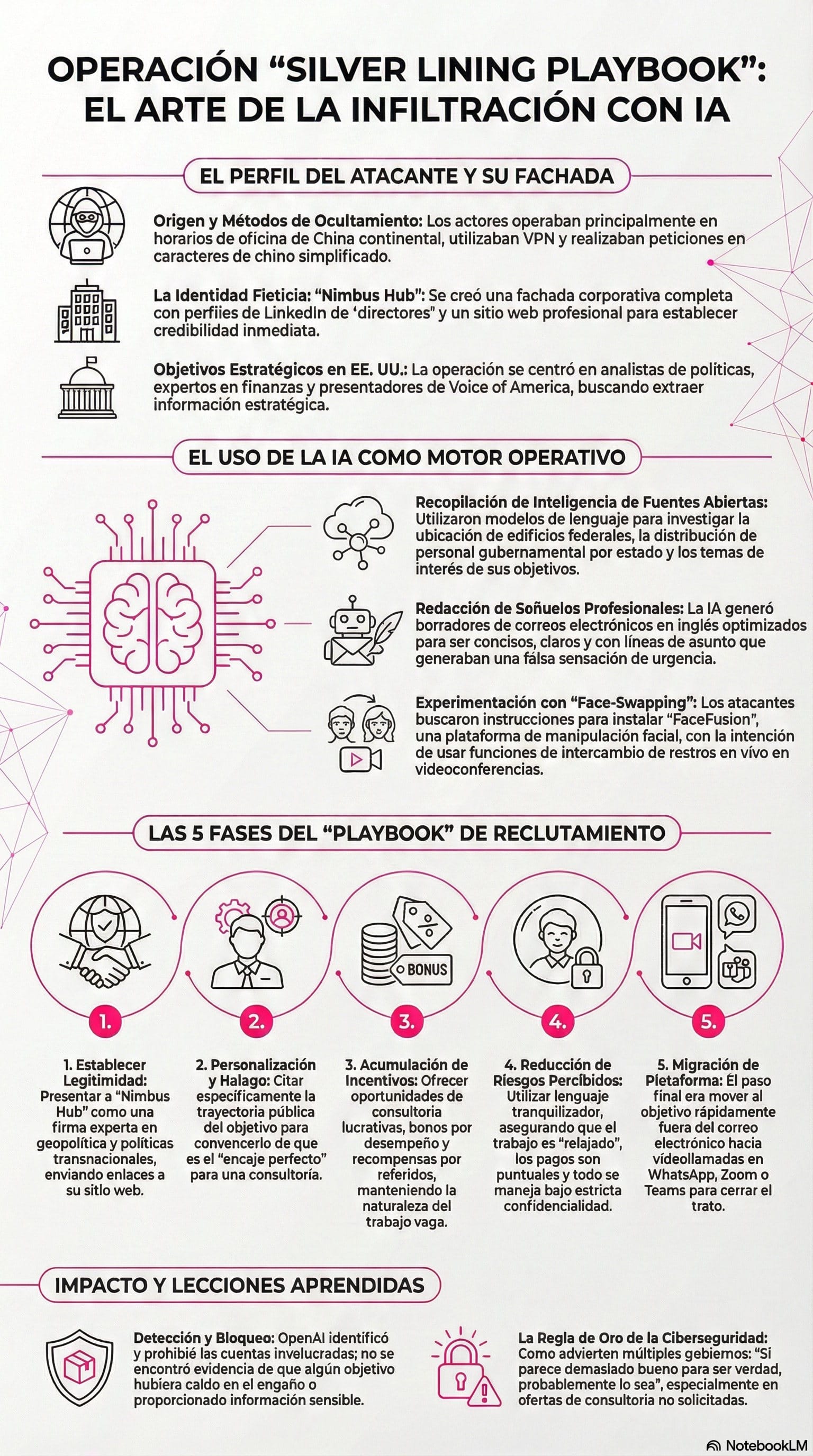

Una reciente investigación titulada “Disrupting malicious uses of our models: an update, February 2026” elaborada por OpenAI reveló cómo actores maliciosos utilizan modelos generativos para crear perfiles falsos de consultoras y engañar a profesionales del sector. Esta modalidad de espionaje busca establecer contacto con analistas mediante aparentes ofertas de asesoría estratégica para vulnerar la seguridad institucional.

Falsas ofertas de consultoría como vector de ataque

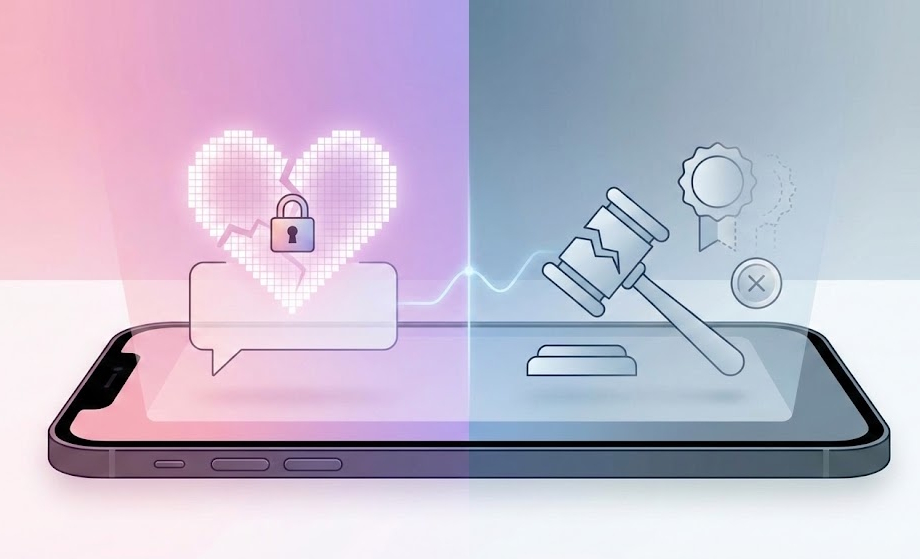

El equipo de seguridad de la compañía tecnológica identificó una operación internacional que redactaba correos electrónicos en inglés orientados específicamente a perfiles gerenciales y funcionarios gubernamentales. Los atacantes estructuraban sus mensajes para generar sentido de urgencia y utilizaban tácticas de manipulación psicológica para trasladar la comunicación a plataformas de videoconferencia externas como Zoom o Teams.

Los ciberdelincuentes construían una fachada de legitimidad comercial al inventar empresas de consultoría estratégica con supuesta experiencia en geopolítica transnacional. Esta táctica incluía el desarrollo de sitios web corporativos falsos y la creación de perfiles en plataformas profesionales para dotar de credibilidad a los supuestos reclutadores frente a sus objetivos.

Personalización de ataques mediante perfiles profesionales

El nivel de sofisticación de estas amenazas radica en la personalización extrema de las comunicaciones dirigidas a los ejecutivos. Los atacantes utilizaban capturas de pantalla de los perfiles públicos de las víctimas para instruir a la inteligencia artificial en la redacción de correos halagadores y altamente específicos sobre la experiencia del usuario.

Las falsas ofertas laborales se presentaban como oportunidades lucrativas con bonos de rendimiento para analistas de negocios y finanzas. La estrategia buscaba minimizar la percepción de riesgo al asegurar que el trabajo era confidencial y exigía poco esfuerzo operativo por parte del profesional contactado.

Preparación técnica para la suplantación de identidad

La operación también investigaba software de manipulación facial en tiempo real para sus comunicaciones en video. Los delincuentes solicitaban instrucciones paso a paso para instalar estos programas de alteración de imagen y así evadir las medidas de verificación visual durante las entrevistas virtuales.

Este nivel de preparación demuestra que los enfoques de ingeniería social ya no se limitan a correos masivos genéricos con errores evidentes. Los directorios deben comprender que estas herramientas permiten a los atacantes simular operaciones corporativas complejas con un nivel de persuasión diseñado para engañar incluso a profesionales altamente capacitados.