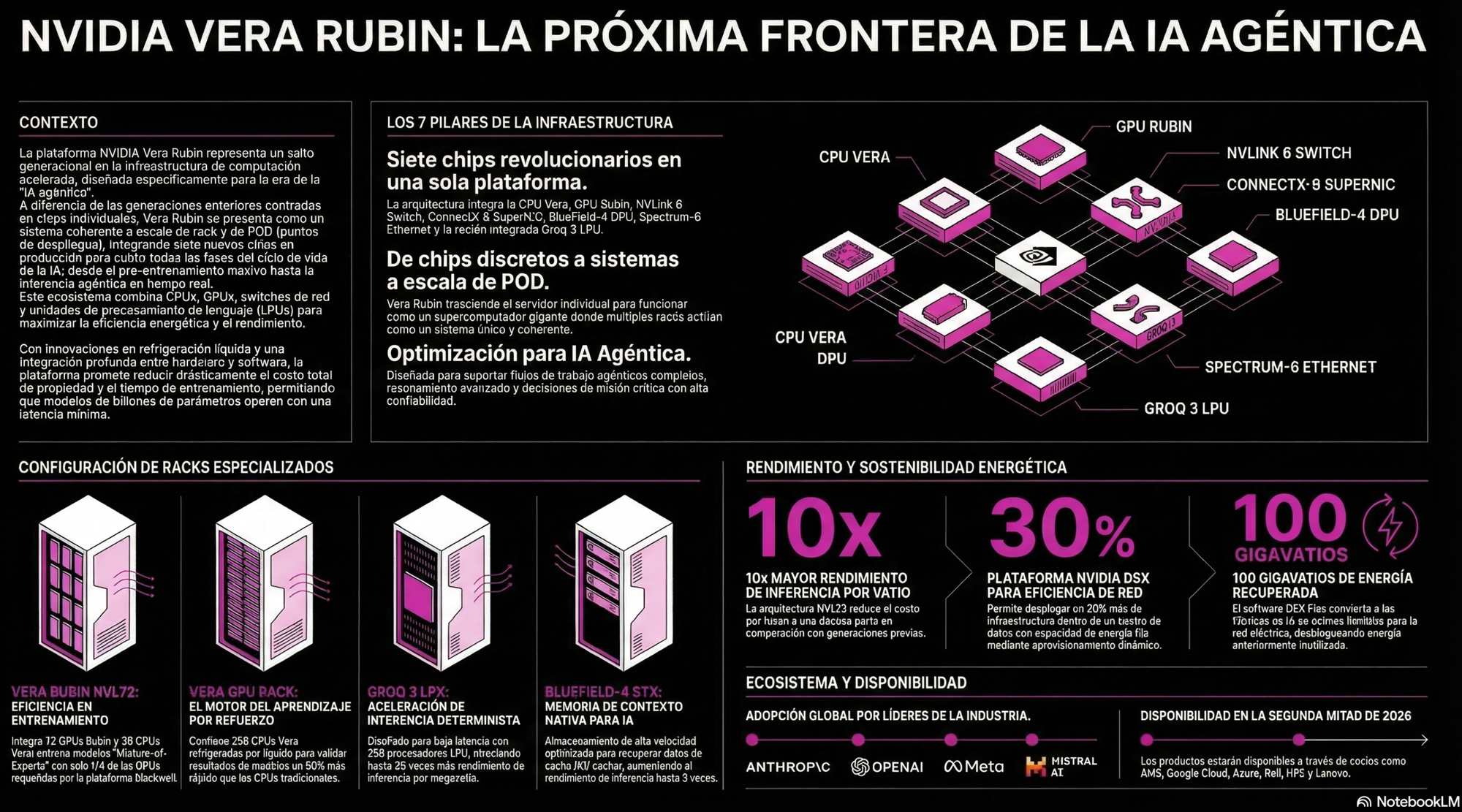

NVIDIA presentó Vera Rubin en GTC 2026 como una nueva plataforma de infraestructura para fábricas de IA a gran escala. La propuesta combina CPU, GPU, red, memoria y conmutación dentro de una arquitectura pensada para cubrir entrenamiento, post-entrenamiento e inferencia en sistemas basados en agentes.

Vera Rubin busca llevar la IA desde el chip individual a la fábrica de IA completa

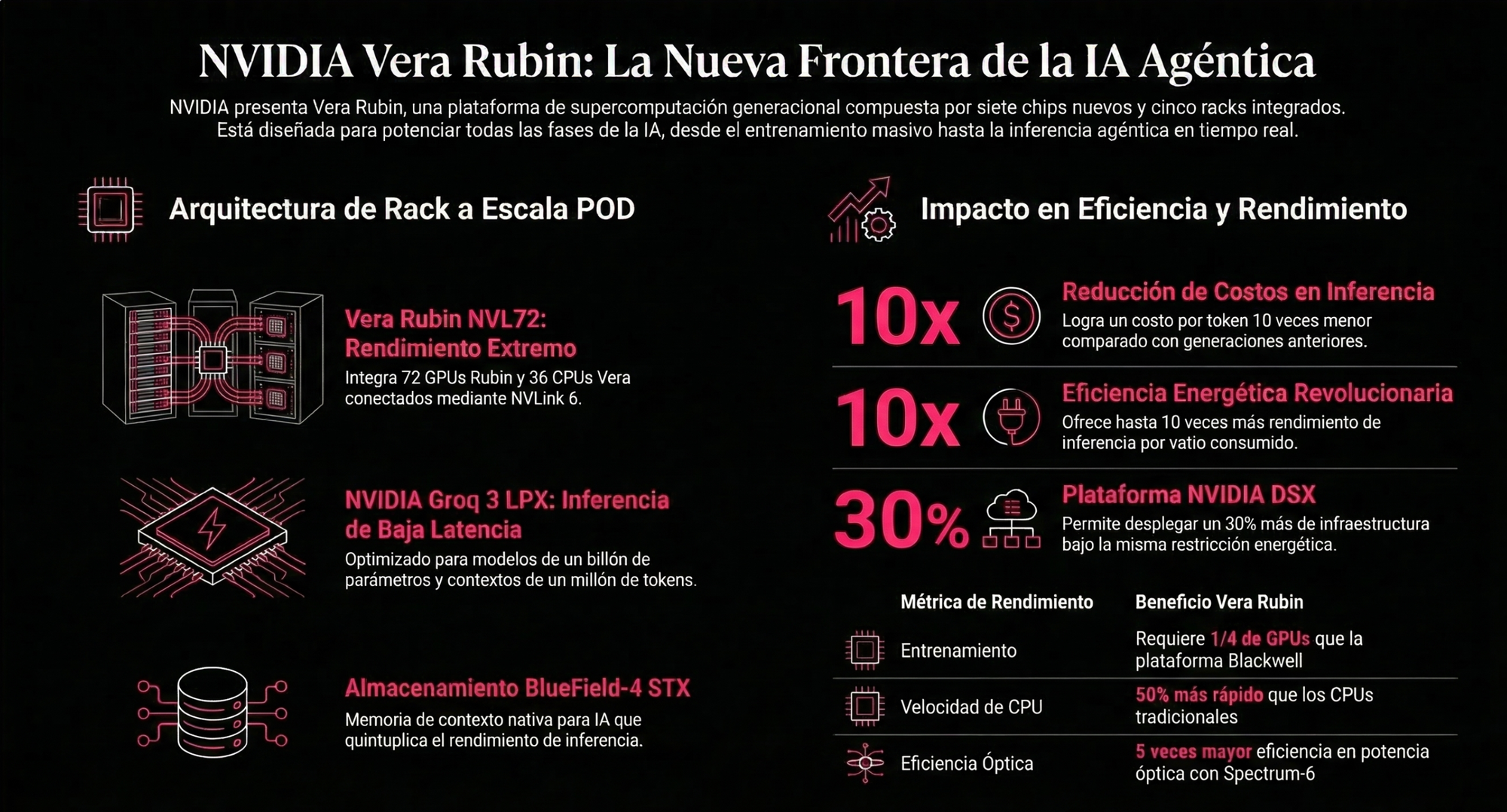

La compañía describió a Vera Rubin como un sistema integrado que reúne siete chips ya en producción. El conjunto incorpora CPU Vera, GPU Rubin, NVLink 6, SuperNIC ConnectX-9, DPU BlueField-4, Ethernet Spectrum-6 y la integración de Groq 3.

La idea central es pasar de servidores aislados a racks completos, despliegues tipo POD y fábricas de IA más amplias. NVIDIA sostiene que esta base puede operar como un supercomputador de IA unificado para tareas de pretraining, post-training, test-time scaling e inferencia de agentes.

En la presentación oficial, Jensen Huang, fundador y CEO de NVIDIA, planteó que Vera Rubin debe entenderse como una arquitectura de escala completa para la siguiente etapa operativa de la inteligencia artificial.

"Vera Rubin es un salto generacional — siete chips de vanguardia, cinco racks y un supercomputador — construido para cubrir cada fase de la IA; el punto de inflexión de la IA con agentes ya llegó con Vera Rubin, que da inicio al mayor despliegue de infraestructura de la historia".

La plataforma apunta a reducir las GPU necesarias y bajar el costo por token

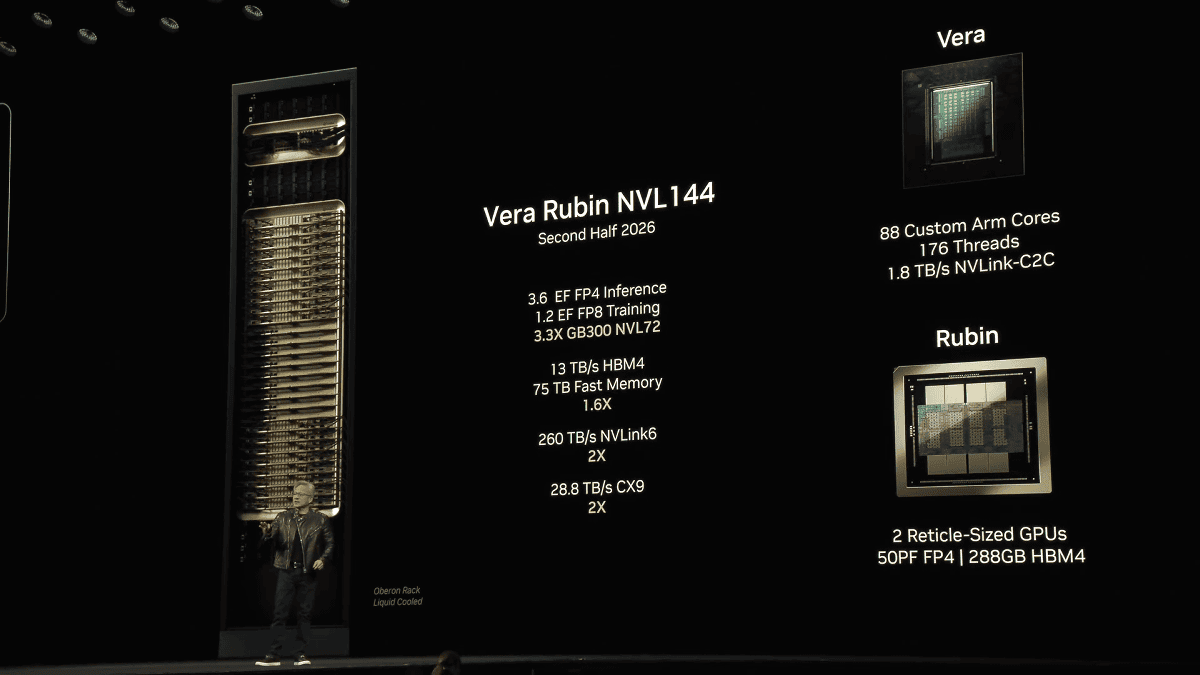

El rack Vera Rubin NVL72 integra 72 GPU Rubin y 36 CPU Vera conectadas mediante NVLink 6, junto con SuperNIC ConnectX-9 y DPU BlueField-4. Según NVIDIA, esta configuración puede entrenar grandes modelos mixture-of-experts con una cuarta parte de las GPU requeridas por Blackwell.

La empresa también afirma que el sistema puede entregar hasta 10 veces más rendimiento de inferencia por watt y reducir el costo por token a una décima parte. A esto se suman un rack Vera CPU para validación y refuerzo, un rack Groq 3 LPX para inferencia de baja latencia y un rack BlueField-4 STX orientado a memoria de contexto.

NVIDIA añadió que DOCA Memos, su framework para BlueField-4, puede elevar hasta cinco veces el rendimiento de inferencia al procesar almacenamiento dedicado para caché clave-valor. Ese punto apunta a uno de los desafíos clave de la IA con agentes, que es sostener contexto, coherencia y velocidad bajo cargas crecientes.

Desde Mistral AI, Timothée Lacroix, cofundador y director de tecnología, enfocó su comentario en la capa de memoria de contexto que requiere este tipo de despliegues para operar con mayor estabilidad y escala.

"El sistema de almacenamiento de memoria de contexto BlueField-4 STX de NVIDIA permitirá el aumento crítico de rendimiento que necesitamos para escalar exponencialmente nuestros esfuerzos en IA con agentes; al ofrecer una nueva capa de almacenamiento diseñada para la memoria de los agentes de IA, STX queda bien posicionado para asegurar que nuestros modelos mantengan coherencia y velocidad al razonar sobre grandes conjuntos de datos".

Socios cloud, fabricantes y calendario de disponibilidad para 2026

El anuncio también incluyó la plataforma DSX para Vera Rubin. En ese marco, NVIDIA indicó que DSX Max-Q permitiría desplegar 30% más infraestructura de IA dentro de un data center con potencia fija, mientras DSX Flex se plantea como una vía para habilitar 100 gigawatts de capacidad eléctrica hoy no aprovechada en la red.

En cuanto a disponibilidad, la empresa señaló que los productos basados en Vera Rubin estarán en manos de socios desde la segunda mitad de 2026. Entre los actores mencionados aparecen Amazon Web Services, Google Cloud, Microsoft Azure y Oracle Cloud Infrastructure, junto con CoreWeave, Crusoe, Lambda, Nebius, Nscale y Together AI.

A nivel de sistemas, NVIDIA indicó que Cisco, Dell Technologies, HPE, Lenovo y Supermicro preparan servidores basados en Vera Rubin. El comunicado también menciona que Anthropic, Meta, Mistral AI y OpenAI evalúan la plataforma para entrenar modelos mayores y operar sistemas multimodales de largo contexto con menor latencia y costo que generaciones previas.

Desde Anthropic, Dario Amodei, CEO y cofundador, vinculó la plataforma con una demanda concreta del mercado, donde el razonamiento más complejo y los flujos de trabajo con agentes exigen infraestructura más robusta y confiable.

"Las empresas y los desarrolladores están usando Claude para razonamiento cada vez más complejo, flujos de trabajo con agentes y decisiones de misión crítica; eso exige una infraestructura capaz de seguir el ritmo, y la plataforma Vera Rubin de NVIDIA nos entrega el cómputo, la red y el diseño de sistema para seguir avanzando mientras reforzamos la seguridad y la confiabilidad de las que dependen nuestros clientes".