En los últimos años la Inteligencia Artificial (IA) se ha consolidado como una herramienta esencial para anticipar ciberamenazas. Aunque su capacidad de detectar patrones y responder en tiempo real la volvió indispensable, la reciente RSA Conference 2025 confirmó lo que muchos ya advertían: estamos entrando en una etapa donde la IA ya no es solo una aliada, sino también una superficie de ataque.

Según nuestra propia estimación, mientras los sistemas de machine learning detectarán hasta el 85% de las amenazas en tiempo real este año, en paralelo tiempo los atacantes también se han sofisticado.

Casos como el del deepfake que logró defraudar US$25 millones en Hong Kong o campañas de phishing generadas por IA que imitan con precisión marcas y vocerías, reflejan un salto cualitativo: el 78% de las personas no logra distinguir un deepfake de una grabación real. Y esto no solo afecta al ecosistema técnico, sino también al juicio cotidiano de empleados, ejecutivos y usuarios finales.

La amenaza es real. En 2024, los ciberataques globales crecieron un 44%, con sectores como educación (+75%), salud (+47%) y telecomunicaciones (+40%) entre los más afectados. En Chile, los ataques aumentaron en más de un 50% en los primeros meses de 2025. Y si bien los modelos defensivos con IA siguen siendo eficaces, enfrentamos una nueva ola de ataques dirigidos contra la IA misma, como el envenenamiento de datos (data poisoning), la clonación de comportamiento de modelos o el prompt injection, que altera instrucciones en tiempo real.

Estos vectores de ataque —aún poco visibilizados en muchas estrategias de ciberseguridad— representan riesgos concretos. Porque si un modelo de IA es manipulado desde su entrenamiento, puede tomar decisiones erróneas sin que sus operadores lo noten. Si es clonado, su lógica puede ser replicada por atacantes. Y si es víctima de inyecciones de instrucciones, su funcionamiento puede ser desviado sin que nadie lo detecte.

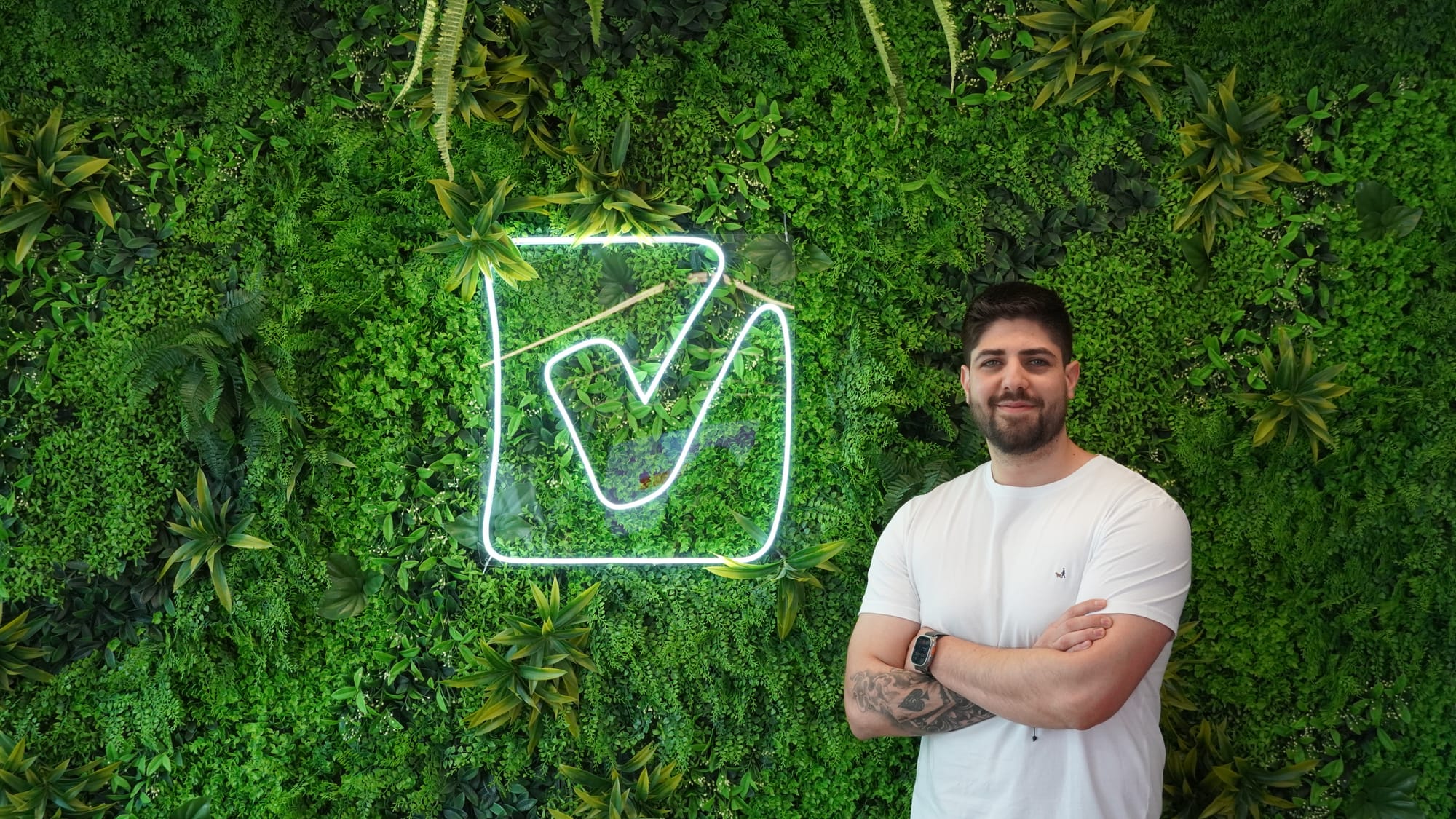

En NeoSecure by SEK utilizamos IA para fortalecer nuestras propias capacidades defensivas: analizamos comportamiento de amenazas, automatizamos respuestas y optimizamos detección en sectores clave como retail, banca y salud.

Por eso, insistimos: no basta con proteger datos o redes. Hoy también es clave anticiparse a los ataques que buscan comprometer los propios modelos de IA. Y esto requiere adoptar principios como secure by design, implementar prácticas de red teaming específicas para IA y promover una gobernanza robusta, que garantice trazabilidad, auditabilidad y control ético del uso de esta tecnología.

En 2024, solo el 5% de las empresas contaba con tecnologías para enfrentar la desinformación digital. Este año, se espera que el 50% las adopte. Es una señal de que la gobernanza de IA deja de ser un ideal para transformarse en una necesidad urgente, sobre todo en sectores como finanzas, educación y salud, donde los errores no solo cuestan dinero, sino también confianza social.

Blindar la IA no es solo blindar el modelo: es proteger la lógica, los datos, los accesos, los sesgos, los resultados. Porque en esta nueva era digital, blindar la inteligencia artificial es blindar el negocio.