Nvidia y ServiceNow trabajaron conjuntamente en el desarrollo de un modelo grande de lenguaje (LLM) de código abierto para la creación de agentes de IA, que fue presentado en la conferencia anual Knowledge 2025 de ServiceNow y denominado Apriel Nemotron 15B.

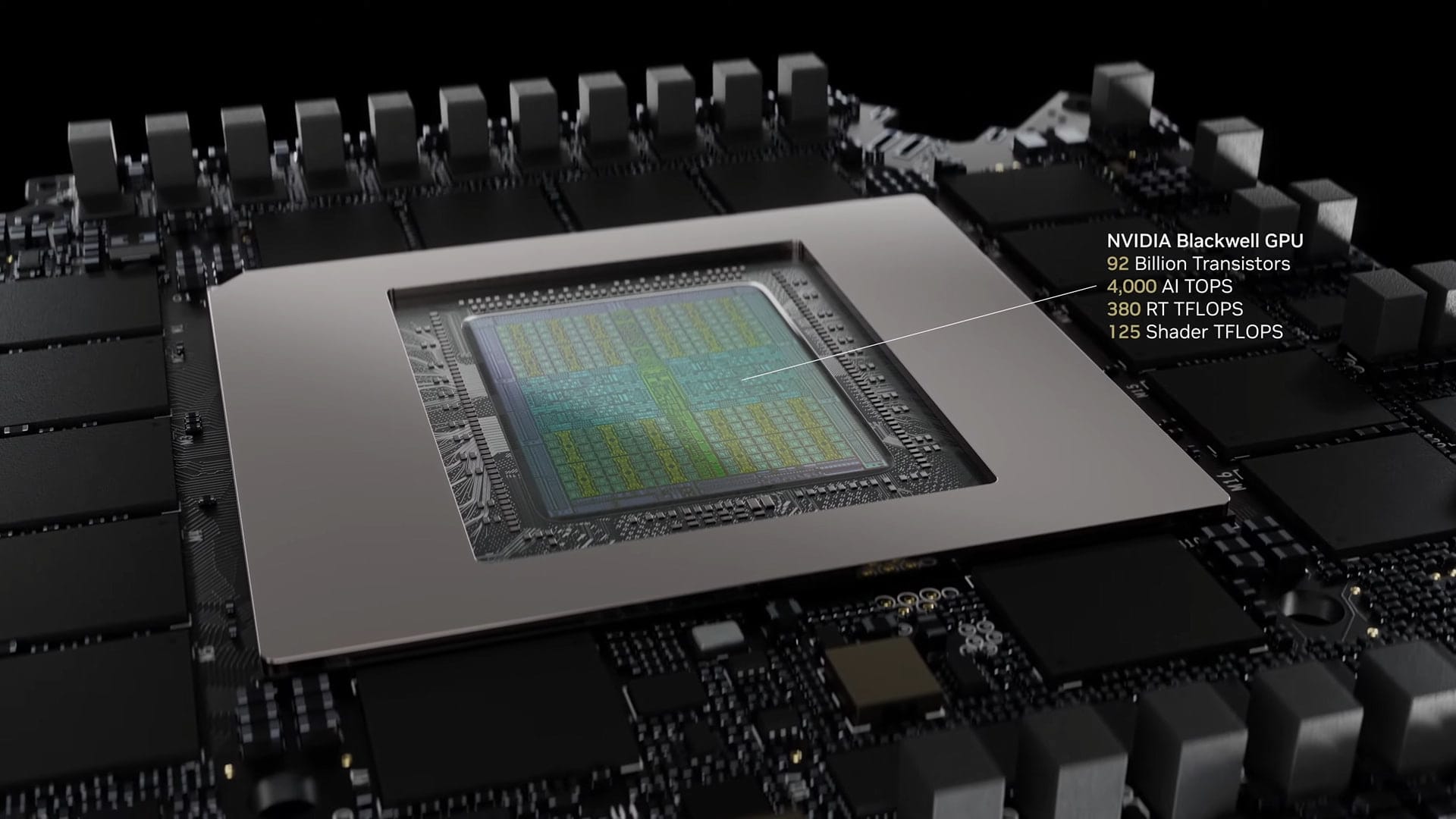

Las principales ventajas de Apriel incluyen la integración de capacidades de razonamiento avanzado en un tamaño más reducido que el de otros modelos, comparando sus 15.000 millones de parámetros con los tres billones de otros LLMs. Esto permite que su entrenamiento sea más veloz y económico cuando se realiza utilizando infraestructura de GPU de Nvidia como un microservicio Nvidia NIM.

Apriel, que estará disponible durante el segundo trimestre de 2025, simplificará la creación de agentes de IA que puedan tomar decisiones sobre TI, recursos humanos y determinadas funciones en servicio de atención al cliente.

Jon Siegler, Vicepresidente de Plataforma e IA de ServiceNow, explica que:

“El modelo Apriel Nemotron 15B, desarrollado por dos de las empresas de IA empresarial más avanzadas, cuenta con un razonamiento específico para impulsar la próxima generación de agentes de IA inteligentes. Esto logra lo que los modelos genéricos no pueden, combinando datos empresariales en tiempo real, el contexto del flujo de trabajo y un razonamiento avanzado para ayudar a los agentes de IA a impulsar la productividad real”.

Kari Briski, Vicepresidenta de software de IA generativa de Nvidia, destacó que junto con ServiceNow han elaborado:

“un modelo eficiente y listo para su uso en empresas que impulsa una nueva clase de agentes de IA inteligentes capaces de razonar para aumentar la productividad de los equipos. Al utilizar el conjunto de datos Nvidia Llama Nemotron Post-Training y los datos específicos del dominio de ServiceNow, Apriel Nemotron 15B ofrece capacidades de razonamiento avanzadas en un tamaño más pequeño, lo que lo hace más rápido, preciso y rentable”.