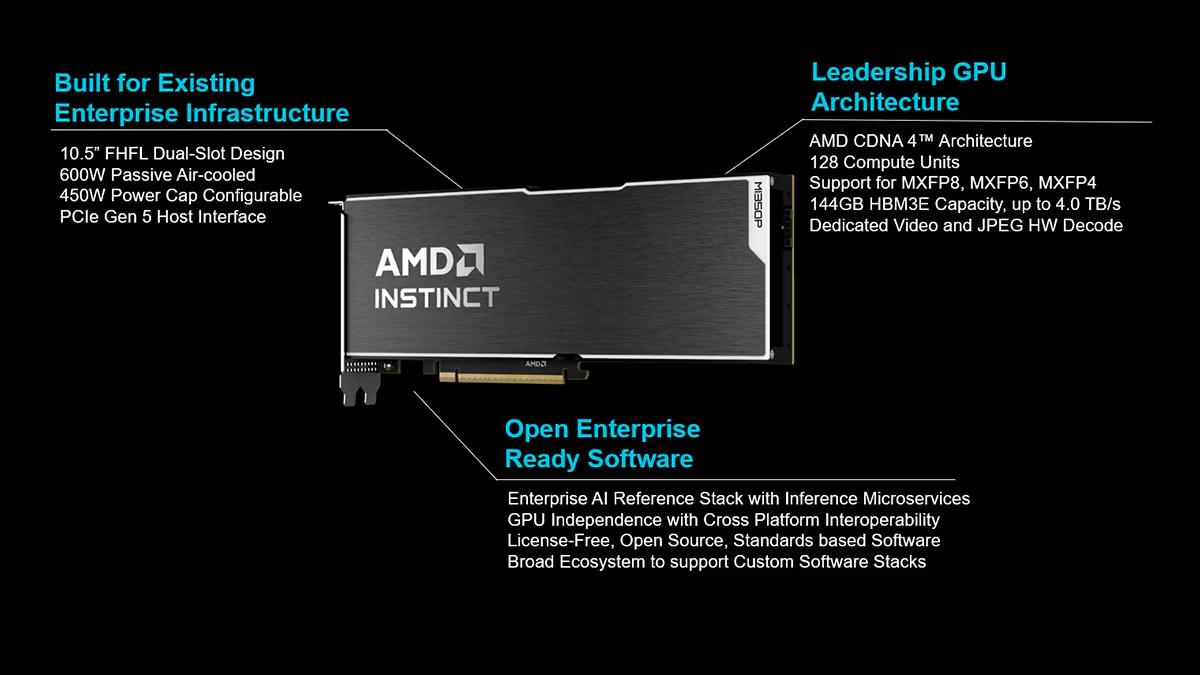

AMD presentó la Instinct MI350P PCIe como una GPU para empresas que quieren ejecutar inferencia de IA en centros de datos propios, sin rediseñar energía, refrigeración ni racks. La tarjeta está pensada para servidores estándar con aire y para organizaciones que necesitan más cómputo que el disponible solo con CPU.

Una GPU PCIe para inferencia y flujos RAG

La MI350P PCIe apunta a modelos pequeños, medianos y grandes, además de flujos de recuperación aumentada por generación. AMD la describe como una tarjeta PCIe dual-slot para sistemas con refrigeración por aire y configuraciones con hasta ocho aceleradores.

El hardware declara 144 GB de memoria HBM3E, hasta 4 TB/s de ancho de banda y soporte para MXFP6, MXFP4, FP8 y MXFP8. AMD también estima hasta 2.299 TFLOPS y un máximo de 4.600 TFLOPS en MXFP4, cifras que la compañía identifica como preliminares.

Socios apuntan a producción local y operación a escala

El mensaje de AMD se concentra en una adopción menos disruptiva para empresas que ya tienen infraestructura instalada. La clave no es solo sumar aceleradores, sino llevar inferencia a producción sin rehacer el centro de datos ni depender de costos variables por uso en la nube.

Infraestructura local y servidores empresariales

David Schmidt, vicepresidente de Product Management en Dell Technologies, situó la MI350P PCIe en una decisión de infraestructura propia. Para clientes corporativos, el valor no pasa solo por cómputo, sino por control, seguridad y previsibilidad operativa.

«Para las empresas que se toman en serio la IA, la infraestructura local no es una concesión. Es una ventaja competitiva que entrega el control, la seguridad y los resultados predecibles que más importan. [...] Dell PowerEdge junto a AMD Instinct MI350P PCIe ofrece a los clientes un camino directo hacia esa ventaja».

Krista Satterthwaite, senior vice president and general manager of Compute en HPE, enfocó el anuncio en servidores ProLiant. Su lectura apunta a clientes que necesitan IA productiva sin abandonar eficiencia, confiabilidad ni soporte empresarial.

«HPE está comprometida con ayudar a los clientes a operacionalizar la IA para su negocio. Con AMD MI350P, estamos ampliando las opciones de servidores HPE ProLiant disponibles para los clientes, que entregarán desempeño de IA, eficiencia y confiabilidad de nivel empresarial».

Software abierto y virtualización

Brian Stevens, senior vice president y AI chief technology officer de Red Hat, puso el énfasis en la operación a escala. El desafío empresarial aparece cuando la prueba inicial debe convertirse en una plataforma administrable y abierta.

«A medida que las empresas avanzan más allá de los experimentos con IA, el desafío real es operacionalizar el hardware a escala. [...] La combinación con plataformas Red Hat AI permite desplegar y gestionar cargas en la nube híbrida, y ayuda a cerrar la brecha entre la experimentación y la IA de nivel productivo».

Paul Turner, chief product officer de la división VCF de Broadcom, subrayó la compatibilidad con entornos virtualizados existentes. Ese punto importa para empresas que ya operan infraestructura consolidada y no pueden absorber rediseños amplios del centro de datos.

«VMware Cloud Foundation sobre GPU AMD Instinct MI350P llevará la flexibilidad, la optimización de recursos y la simplicidad operativa de la virtualización a los despliegues de IA. Las organizaciones podrán gestionar aceleradores de IA dentro de sus entornos virtualizados existentes sin rediseños del centro de datos [...]».

AMD advierte que los datos de rendimiento corresponden a proyecciones de ingeniería o mediciones tempranas de abril de 2026. Esa cautela deja la validación final en manos de disponibilidad comercial, integración con socios y desempeño real en cargas empresariales.