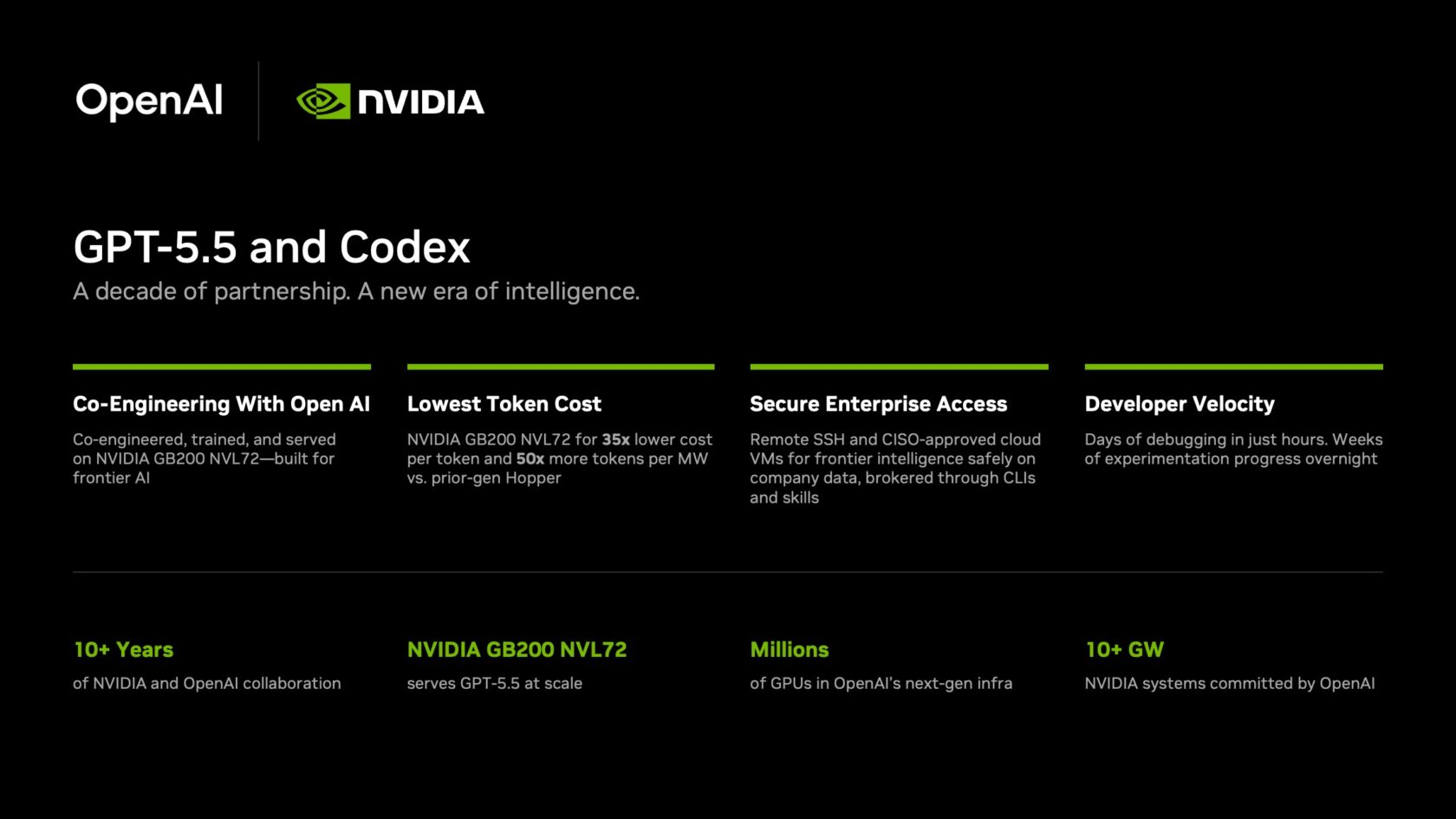

La integración de GPT-5.5 en los sistemas a escala de rack NVIDIA GB200 NVL72 establece un marco económico viable para la inferencia de modelos de lenguaje avanzados en aplicaciones corporativas. Más de diez mil empleados de distintas áreas técnicas y operativas ya ejecutan la herramienta de codificación Codex sobre esta arquitectura compartida para resolver flujos de trabajo diarios.

Arquitectura de procesamiento y eficiencia en el consumo de tokens

El soporte de hardware de la actual generación permite procesar volúmenes masivos de datos corporativos con una estructura de gastos significativamente reducida en comparación con los equipos de arquitectura Hopper. Las especificaciones de los racks entregan un costo treinta y cinco veces menor por cada millón de tokens procesados.

Bajo condiciones de carga operacional máxima, la salida de tokens por segundo experimenta un aumento de cincuenta veces por cada megavatio utilizado. Esta métrica de rendimiento energético determina directamente la viabilidad financiera de mantener agentes de inteligencia artificial operando en entornos de producción ininterrumpida.

Protocolos de acceso seguro a datos empresariales confidenciales

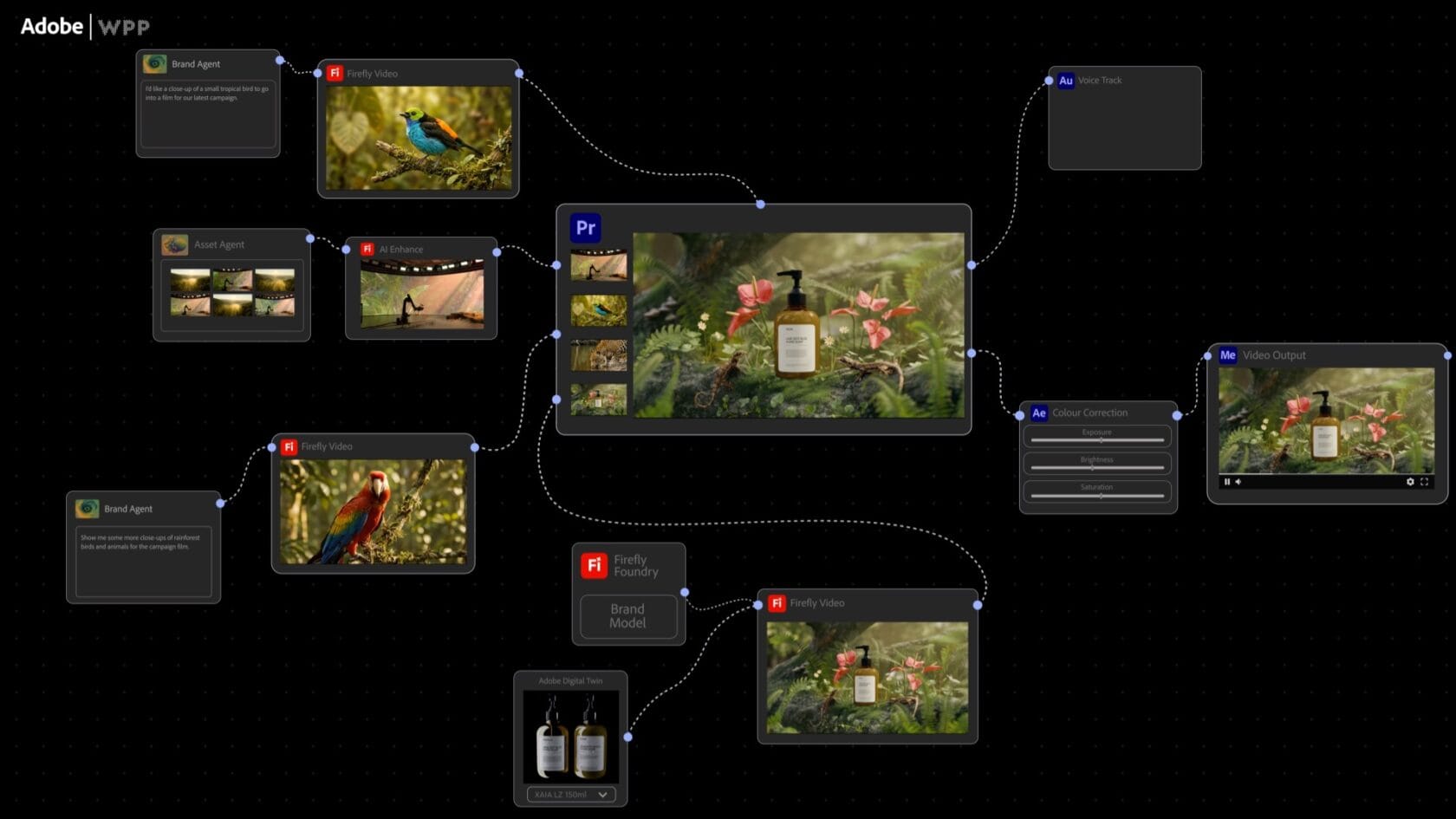

Los agentes acceden a los sistemas bajo permisos de solo lectura canalizados mediante interfaces de comandos. Esta capa preventiva anula la modificación accidental de los repositorios durante la extracción de rutinas de código complejas ejecutadas en la nube.

La administración de la información interna funciona bajo una política estricta de cero retención de datos durante la ejecución paralela de las tareas asignadas. Las conexiones remotas mediante protocolos cifrados habilitan máquinas virtuales aprobadas por los oficiales de seguridad de la información para aislar completamente el entorno de trabajo.

Este cambio estructural requiere liderazgo técnico activo. Jensen Huang, fundador y director ejecutivo de NVIDIA, instruyó a todos sus colaboradores mediante un correo corporativo para adoptar estas herramientas en los procesos diarios de la compañía informática.

Escalabilidad del clúster de entrenamiento durante una década de desarrollo

El lanzamiento reciente consolida más de diez años de trabajo conjunto en el diseño de componentes de silicio adaptados a los requerimientos de carga computacional. El resultado técnico de este proceso radica en la puesta en marcha conjunta del primer clúster equipado con cien mil unidades de procesamiento gráfico de la serie Blackwell.

Los ciclos de retroalimentación sobre la hoja de ruta del hardware permiten ajustar la capacidad de inferencia antes del despliegue comercial final. Las horas invertidas tradicionalmente en la depuración de sistemas quedan reducidas a fracciones operativas sin alterar negativamente la estabilidad del código base resultante.

La identificación precisa de cuellos de botella operativos en las iteraciones anteriores direcciona directamente todas las decisiones de diseño aplicadas a la arquitectura de hardware base. Millones de unidades estructuran las instalaciones de próxima generación.

Los compromisos comerciales de suministro superan los diez gigavatios de capacidad instalada para abastecer estos centros de procesamiento informático. Mantener esta infraestructura operando ininterrumpidamente a escala global exige certificaciones técnicas rigurosas de hardware avaladas por los proveedores de energía y los equipos de seguridad corporativa.

La asignación de presupuesto para estas actualizaciones integrales de equipamiento requiere un análisis sumamente detallado del retorno de inversión basado en el rendimiento computacional comprobado empíricamente. Los directores de tecnología evalúan estas costosas implementaciones físicas midiendo de forma directa la reducción de latencia lograda durante los múltiples ciclos de desarrollo de aplicaciones internas.